Claude Code 是 Anthropic 推出的 AI 编程工具,可以在终端中直接对话,让 AI 写代码、改代码、调试、重构,甚至操作 git。配合 VSCode 扩展使用时,体验几乎就是坐在那说话,AI 在敲代码。

但 Claude Code 的 API 成本不低——Opus 模型 15 美元/百万 token,Sonnet 也要 3 美元。对于想体验或日常高频使用的开发者来说,账单压力不小。

free-claude-code 这个项目解决了这个问题。它在 GitHub 上 Star 数已突破 10.8K,核心思路是做一个轻量级代理服务器,将 Claude Code 的请求转发到免费或便宜的大模型 API 上。

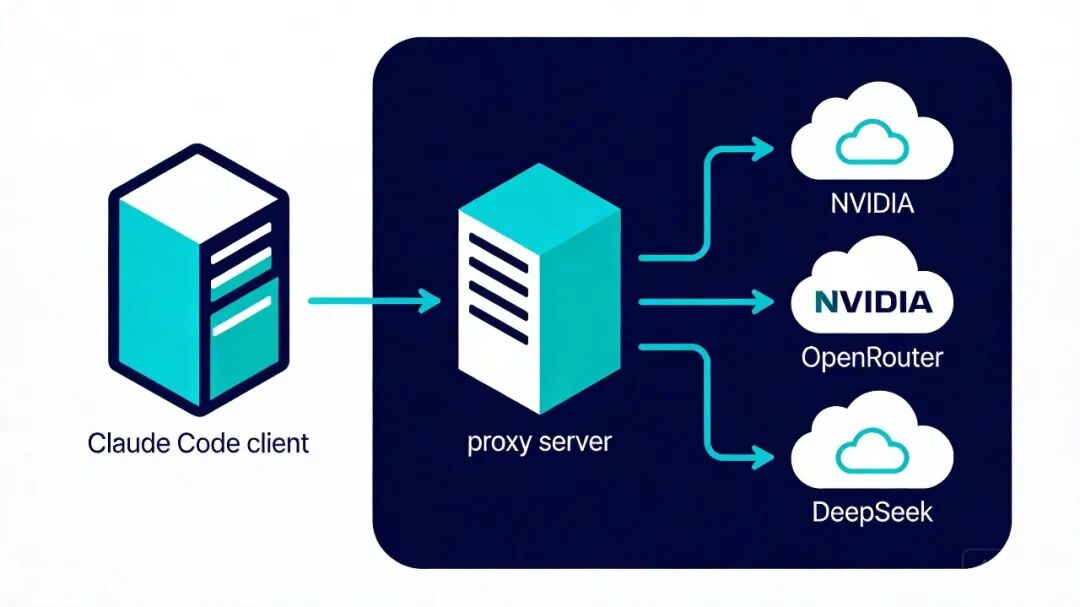

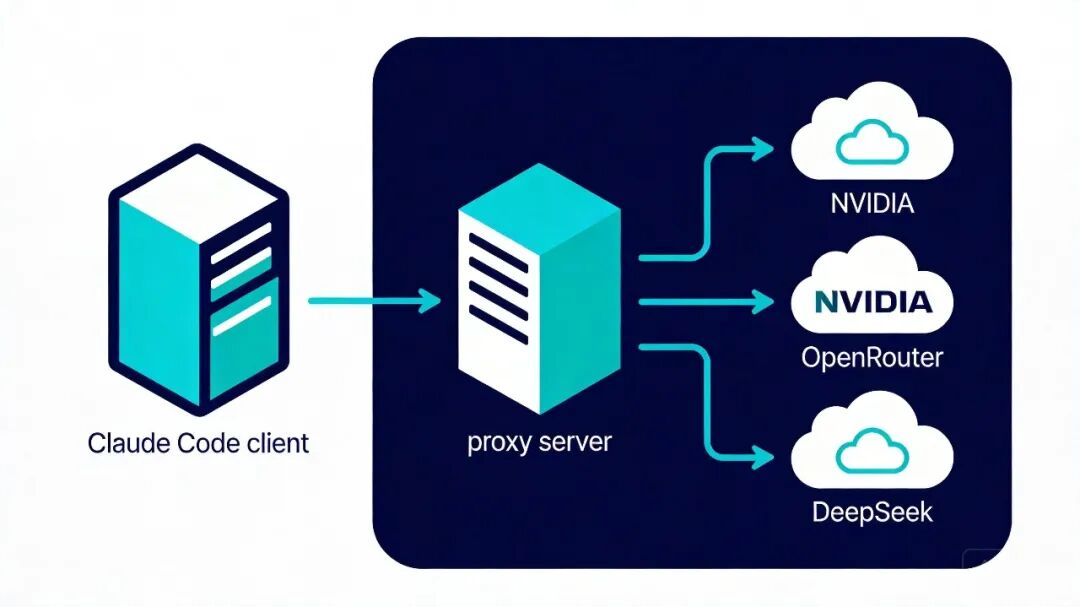

工作原理

free-claude-code 在本地启动一个端口(默认 8082),设置环境变量 ANTHROPIC_BASE_URL 指向这个本地代理后,Claude Code 会以为自己在跟 Anthropic 的服务器通信。实际上,代理将请求转发到配置的其他模型 API,拿到回复后再翻译回 Anthropic 格式。

整个过程中 Claude Code 完全不需要修改任何代码,甚至不需要重新安装,就是两个环境变量的事。

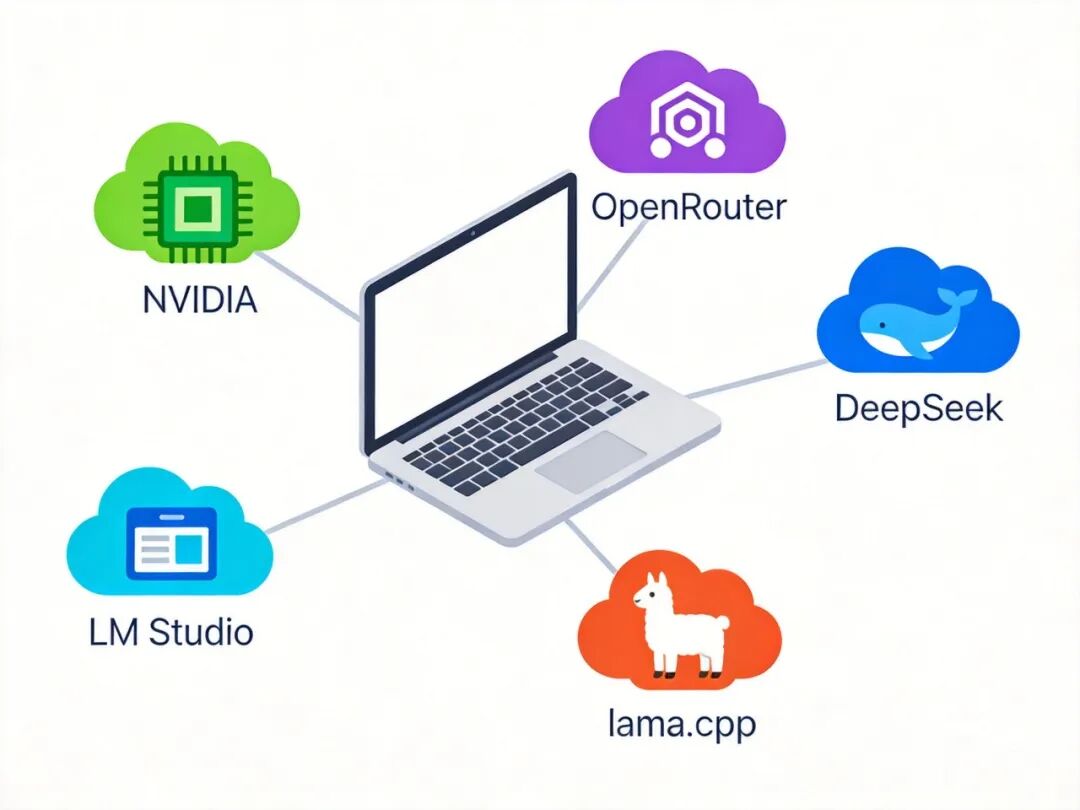

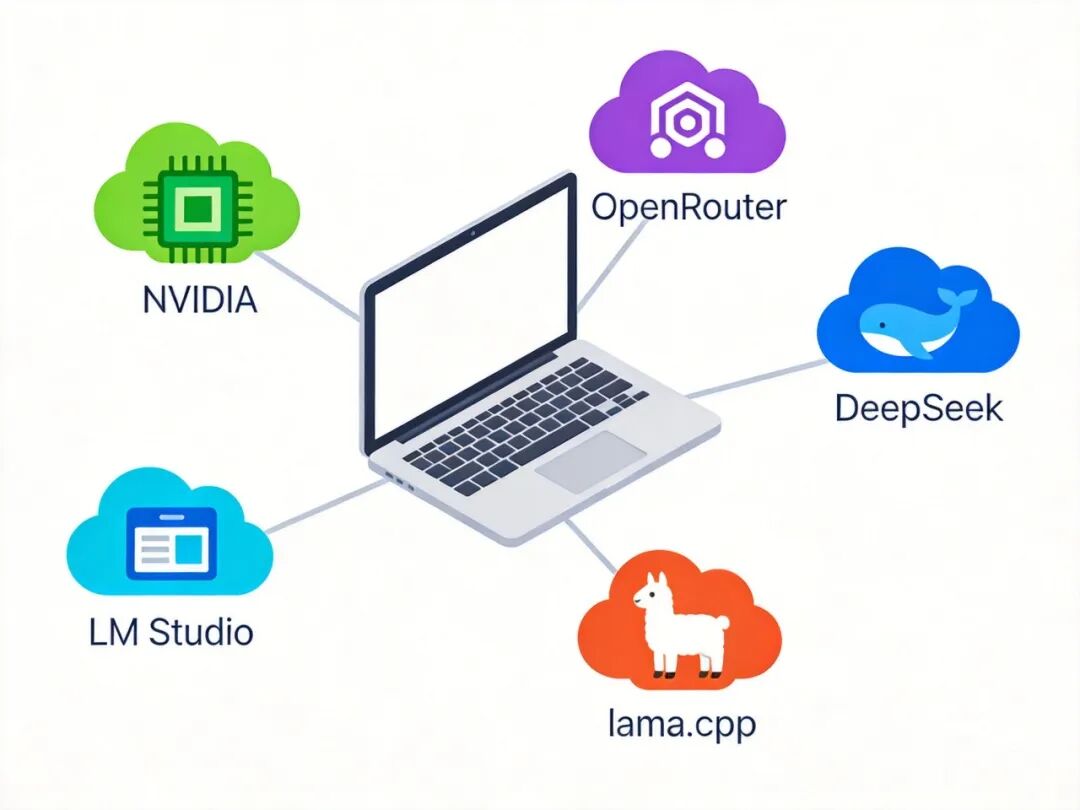

支持的后端

NVIDIA NIM(推荐)

NVIDIA 提供的 API 平台,注册即可获取 Key,免费额度为每分钟 40 次请求。支持 Qwen3.5-397B、Kimi-K2.5、MiniMax-M2.5 等模型,个人开发者完全够用。

OpenRouter

模型聚合平台,有几百个模型可选,包含 DeepSeek R1、GPT-OSS-120B 等免费版本。免费模型的速率限制各不相同,日常使用足够。

DeepSeek 直连

拥有 DeepSeek API Key 的用户可以直接使用 DeepSeek Chat 和 DeepSeek Reasoner,价格比 Anthropic 便宜一个数量级。

LM Studio 和 llama.cpp(完全本地)

不需要任何 API Key,不需要联网,模型跑在本地电脑上。没有速率限制,没有费用,但需要足够的显存或内存。

模型混搭策略

一个实用的功能是支持按请求级别路由到不同模型——Opus 级别路由到强模型,Sonnet 级别路由到另一个,Haiku 级别再换一个。

例如:

- MODEL_OPUS:NVIDIA NIM 的 Qwen3.5-397B

- MODEL_SONNET:OpenRouter 的 DeepSeek R1 免费版

- MODEL_HAIKU:本地 GLM-4.7-Flash

不同复杂度的任务自动走不同质量的模型,既省钱又高效。

实际测试场景

场景一:NVIDIA NIM + Qwen3.5 编写 Python 脚本

任务:批量重命名文件脚本,支持正则匹配、预览模式、撤销操作。整个过程约 3 分钟,代码质量不错,包含单元测试。对于中等复杂度任务完全够用,且零成本。

场景二:OpenRouter 免费模型制作 React 组件

任务:将设计稿转化为可用的 React 组件,包含状态管理和样式。免费模型表现一般——组件能跑,但代码组织不够优雅,边界情况处理不足。换用 DeepSeek Reasoner 后效果明显改善。

苏米注:这个测试说明免费模型并非不可用,但关键任务还是需要选择更可靠的模型。分层使用策略是关键。

场景三:本地 LM Studio 做代码 Review

在本地跑 Qwen3.5-35B 量化模型,完全离线运行,速度飞快,代码不会发送到任何外部服务器。对于处理公司内部代码的场景,这是最推荐的方案。

高级特性

请求优化

Claude Code 运行过程中会发出大量"无用"的 API 请求(检查配额、生成会话标题、检测前缀等)。free-claude-code 在本地拦截这些请求并伪造响应,节省 API 配额。

Thinking Token 支持

自动将 DeepSeek R1 等模型的推理过程包装成 Claude 原生的思考块格式,保证兼容性。

启发式工具解析

部分免费模型不会输出结构化的工具调用 JSON,而是将工具调用写在文本中。代理用启发式算法自动解析并转换为结构化格式。

速率限制

内置滑动窗口速率控制 + 429 自动重试 + 并发数限制,避免请求过于频繁。

Discord / Telegram Bot

可以在 Discord 或 Telegram 上建 Bot,通过手机发消息让 AI 写代码。支持语音消息自动转录、多线程对话、同时跑多个 Claude Code 会话。适合"在路上突然想到 bug 怎么修"的场景。

安装指南

1. 安装 uv

pip install uv

# 已安装则更新

uv self update2. 克隆仓库并配置

git clone https://github.com/Alishahryar1/free-claude-code.git

cd free-claude-code

cp .env.example .env3. 编辑 .env(以 NVIDIA NIM 为例)

NVIDIA_NIM_API_KEY="nvapi-your-key-here"

MODEL_OPUS="deepseek-ai/deepseek-v4-pro"

MODEL_SONNET=

MODEL_HAIKU=

MODEL="nvidia_nim/z-ai/glm4.7" # fallback

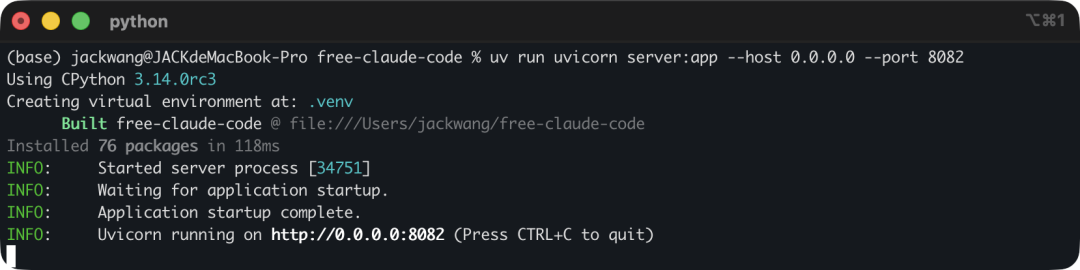

ENABLE_THINKING=true4. 启动代理服务器

uv run uvicorn server:app --host 0.0.0.0 --port 8082

5. 启动 Claude Code

ANTHROPIC_AUTH_TOKEN="freecc" ANTHROPIC_BASE_URL="http://localhost:8082" claude项目还提供 claude-pick 工具,安装 fzf 后可用交互式菜单选择模型。也可以直接作为 Python 包安装,无需克隆仓库。

局限性与注意事项

- 模型质量差距:免费模型与 Claude Opus/Sonnet 仍有差距,复杂的多文件重构和深度架构设计可能力不从心

- 速率限制:NVIDIA NIM 每分钟 40 次请求在处理大型项目时可能不够用

- 第三方代理风险:如果 Anthropic 协议更改或 NVIDIA NIM 免费政策变化,可能随时失效

使用策略建议

日常写代码、小工具开发、脚本编写——用 NVIDIA NIM 免费额度即可。公司项目代码审查——走本地 LM Studio 确保隐私。特别复杂的任务——考虑付费使用 Claude Opus。

这种分层使用方式既不浪费钱,也不牺牲关键场景的体验。

总结

free-claude-code 的核心价值在于让开发者零成本体验 AI 辅助编程的工作方式。解决方案优雅——协议转换代理层,不修改 Claude Code 任何代码,不破坏 Anthropic 协议。对于学习、个人项目或想体验 Claude Code 的用户来说,非常值得一试。