OpenClaw(小龙虾)这个开源 AI 对话框架。它的核心价值在于:提供一个本地部署的 LLM 对话引擎,支持多渠道接入,让你能够在不同平台与 AI 进行交互。

我在实践过程中发现,这套方案的关键优势是渠道灵活性和本地可控性,但也需要一定的技术操作成本。

最近微信推出了一个 ClawBot 的插件,可以把你电脑上安装的小龙虾接入到微信里面。

其实这个插件只是一个渠道,今天就结合微信ClawBot + 飞书,实现多渠道对话接入

一、OpenClaw 本地环境部署

1. 安装 OpenClaw 核心

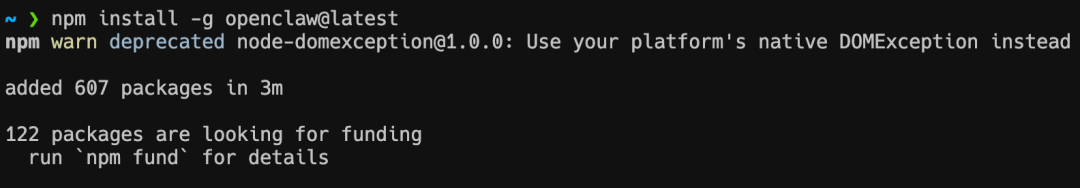

首先,确保你的电脑已安装 Node.js。然后执行以下命令:

npm install -g openclaw@latest该命令会下载并安装 OpenClaw 及其依赖包(通常包含 600+ 个包),预计耗时 3 分钟左右。

如果遇到报错,说明可能未安装 Node.js,建议将错误信息提交给 AI 助手获取解决方案。

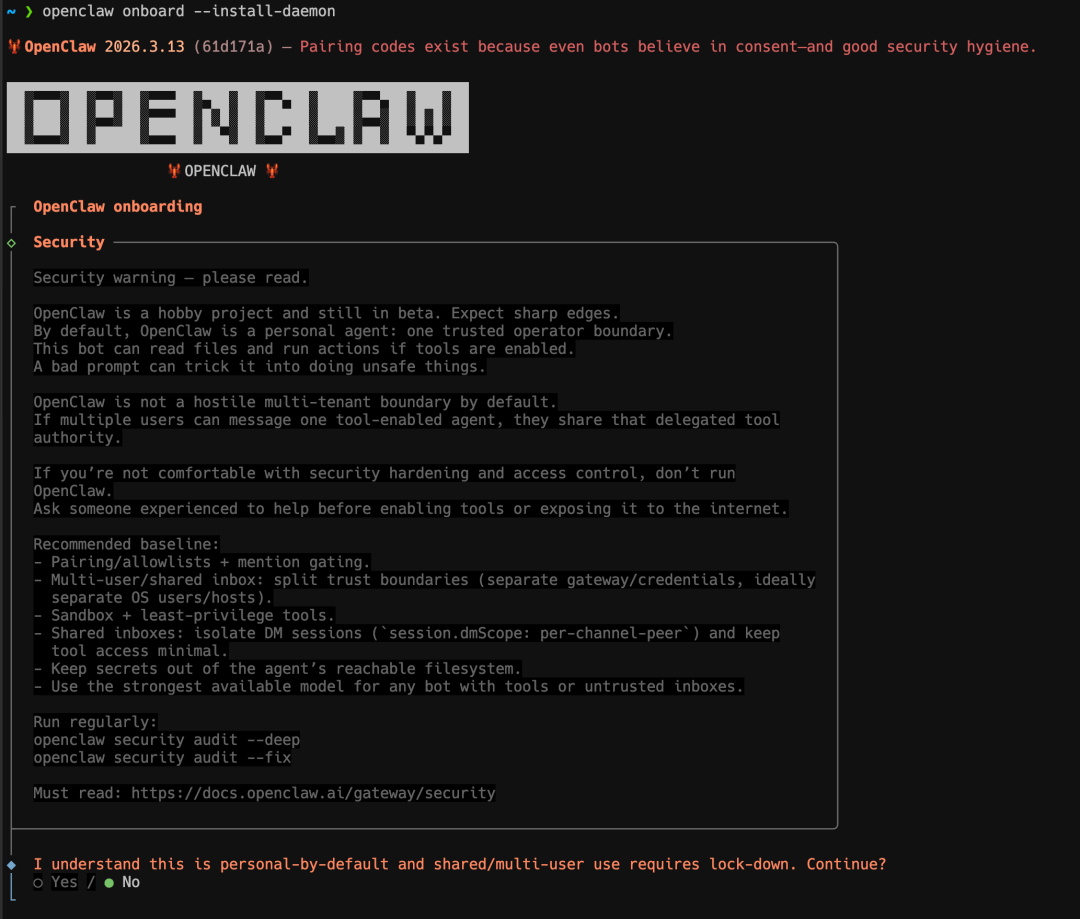

安装完成后,执行后续初始化命令:

openclaw onboard --install-daemon大约 1 分钟后会出现交互式界面,按提示选择 yes 继续。

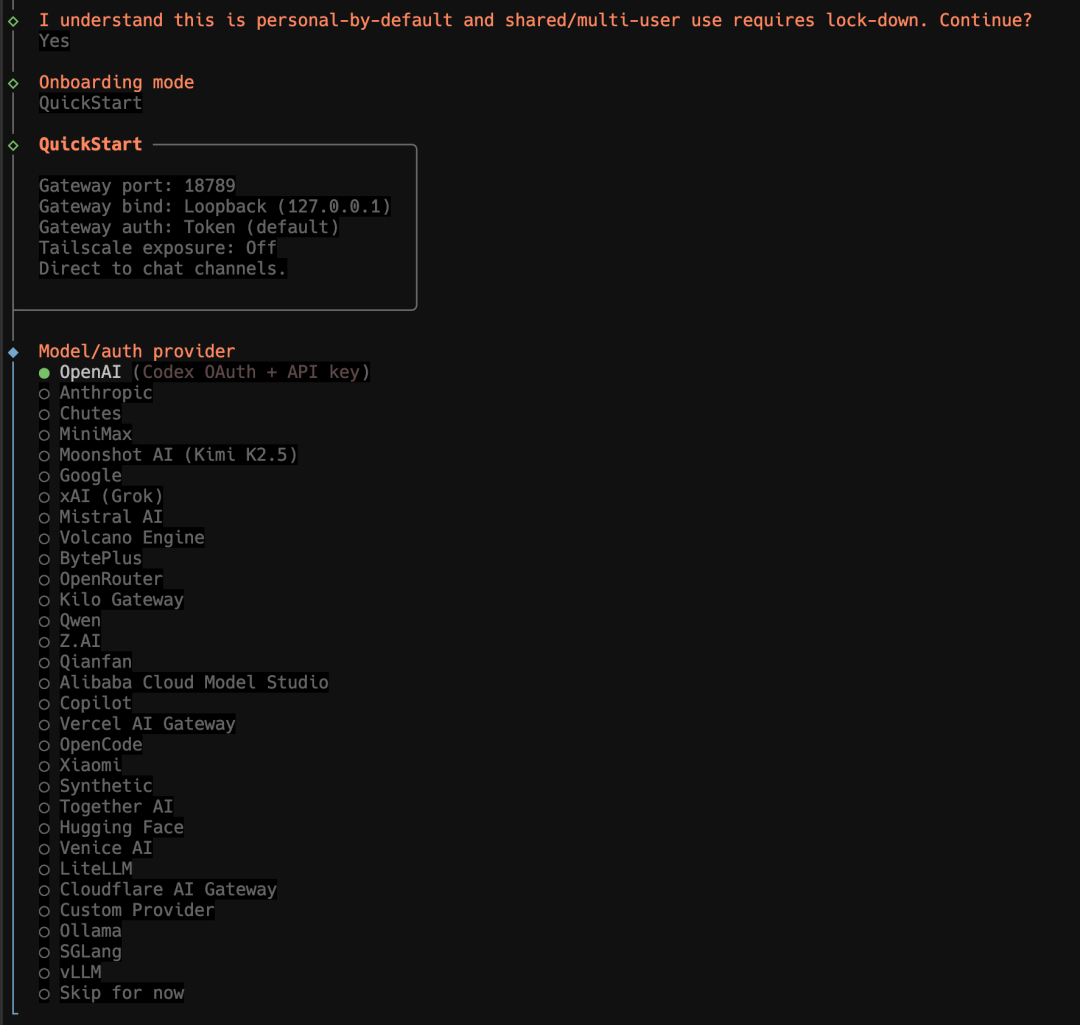

2. 配置大模型 API

OpenClaw 需要接入大语言模型才能工作。平台支持国内外多个厂商(智谱、Kimi、MiniMax、Qwen 等)。

配置时需要注意两个关键点:

- API 计费类型:部分平台区分 Coding Plan 和标准 API 的计费逻辑。如果你购买了 Coding Plan,需确保使用对应的 API Key,否则会产生计费差异。

- 地域区分:OpenClaw Panel 中区分国内和海外 API 服务商。国内平台通常带有 "cn" 后缀,需根据实际情况选择。

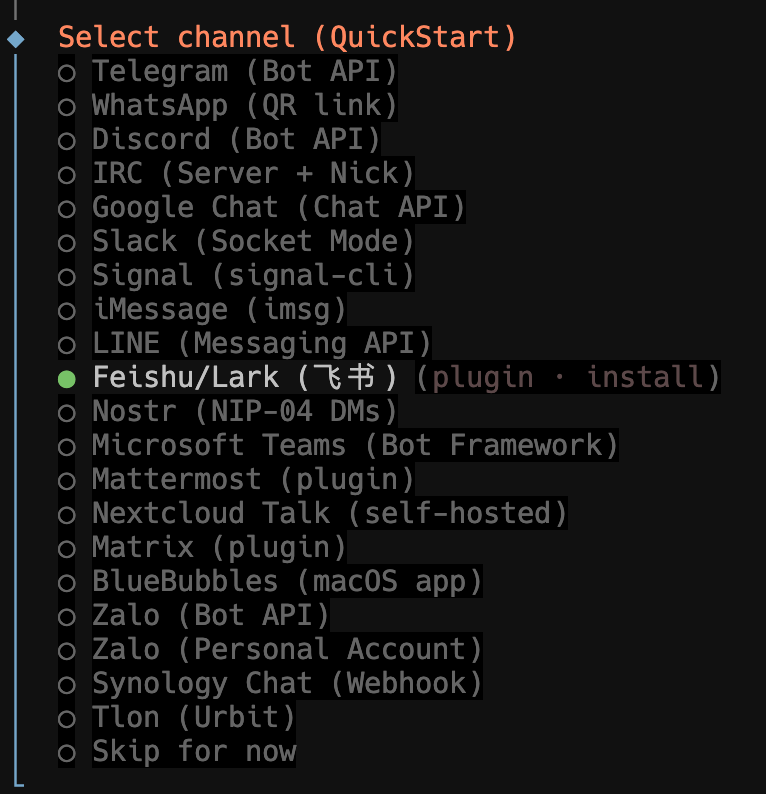

3. 选择初始接入渠道

OpenClaw 支持多渠道集成。

在本教程中,我先将其接入飞书,然后再通过微信插件扩展。

这样做的优势是可以同时在两个平台测试 OpenClaw 的功能。

二、飞书平台配置与集成

1. 创建飞书应用

前往飞书开放平台创建新应用。获取应用的 App ID 和 App Secret(这里就不教创建流程了,之前有创建的教程)。

2. 配置权限

在应用的权限管理模块中,根据需要批量导入权限。

OpenClaw 需要的权限范围较广,涵盖文件操作、数据表管理、消息发送等多个模块。为了保证完整功能,建议参考以下权限范围进行配置:

- 文件类:

aily:file:read、aily:file:write、drive:file等 - 数据表类:

base:record:create、base:record:read、base:record:update等 - 消息类:

im:message:send_as_bot、im:message:update等 - 文档类:

docs:document:copy、docs:document:export等

具体权限需根据你的业务场景选择,无需全部启用。

3. 配置事件与回调

在飞书应用的事件配置中:

- 选择 Long Polling(长链接) 作为回调方式

- 点击"添加事件",根据实际需求选择触发事件(如消息接收、命令触发等)

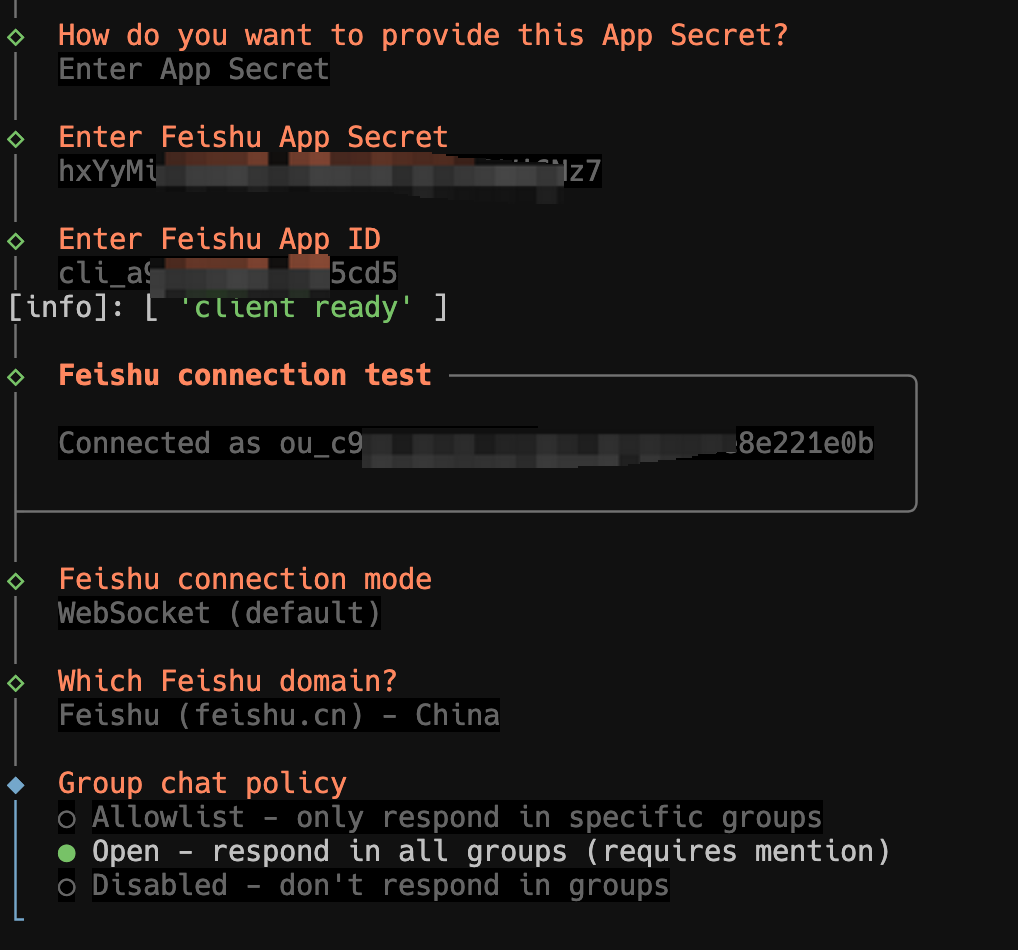

4. 关联 OpenClaw 配置

回到本地终端,在 OpenClaw 初始化过程中输入飞书应用的 App ID 和 App Secret。

系统会询问是否需要配置搜索、Skill、Hook 等高级功能,初期可全部跳过。

5. 发布应用

在飞书开放平台的"版本管理与发布"模块中,将应用状态设为 上线。

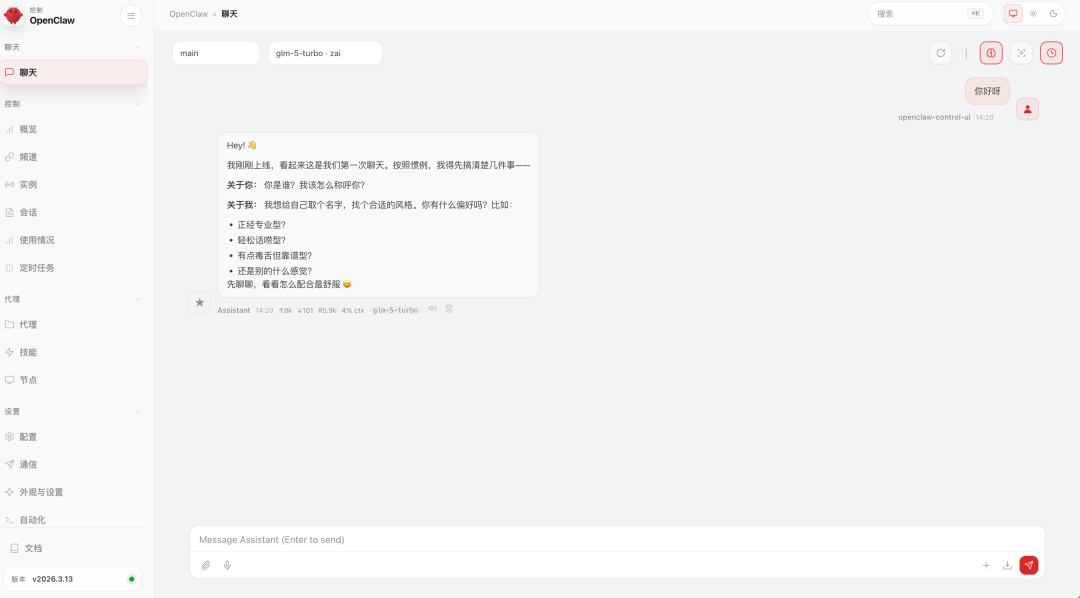

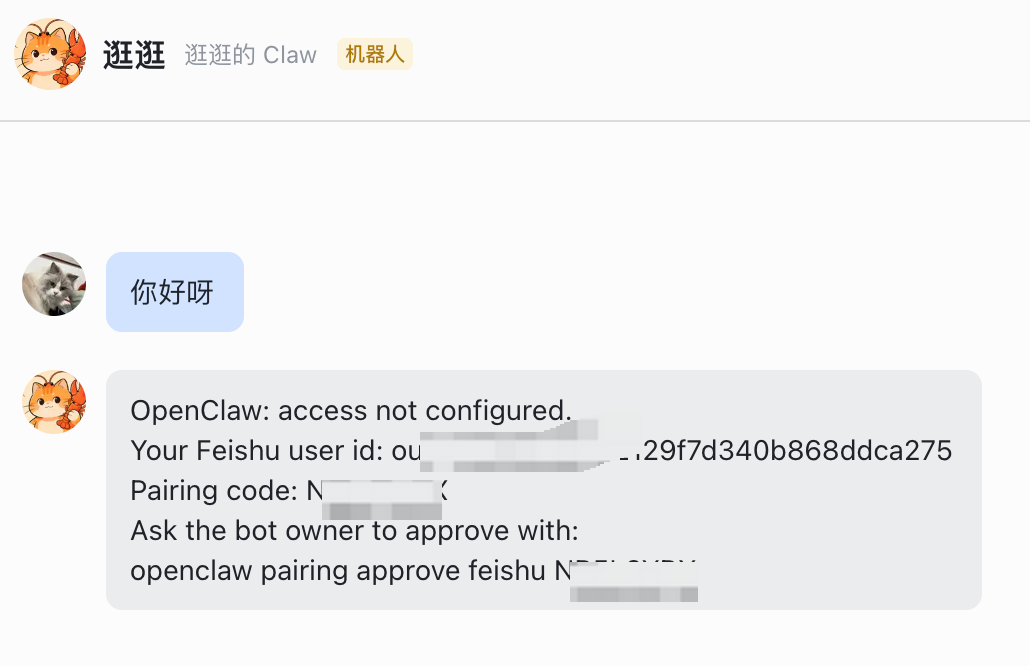

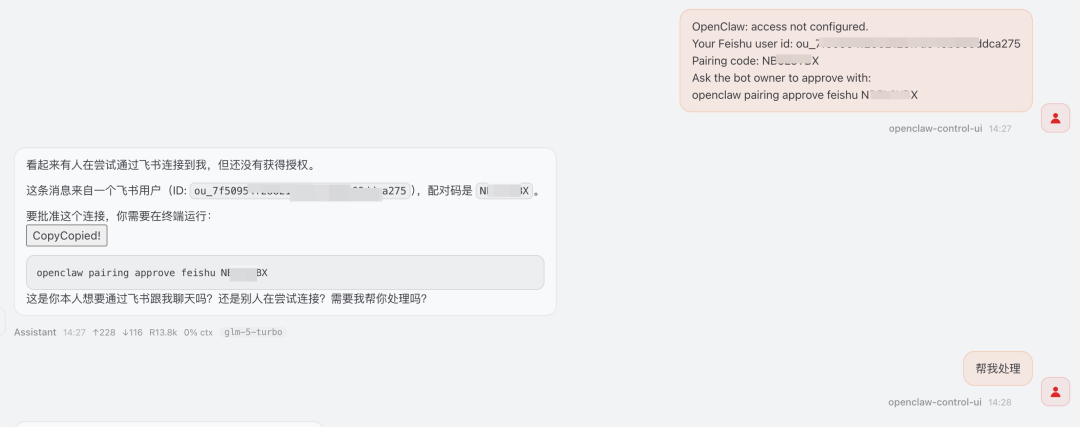

6. Web Gateway 管理与配对

OpenClaw 会自动在本地启动 Web 控制面板(Gateway)。

创建的飞书机器人会生成一个配对码,复制该配对码到 Gateway 控制面板进行配对。

配对成功后,你就能在飞书中与 OpenClaw 进行对话。

三、微信 ClawBot 插件接入

1. 激活微信插件

在微信客户端中,依次进入 我 → 设置 → 插件,查找"微信 ClawBot"。

如果未显示,请更新微信至最新版本,然后在应用商店中搜索并安装。

2. 建立连接

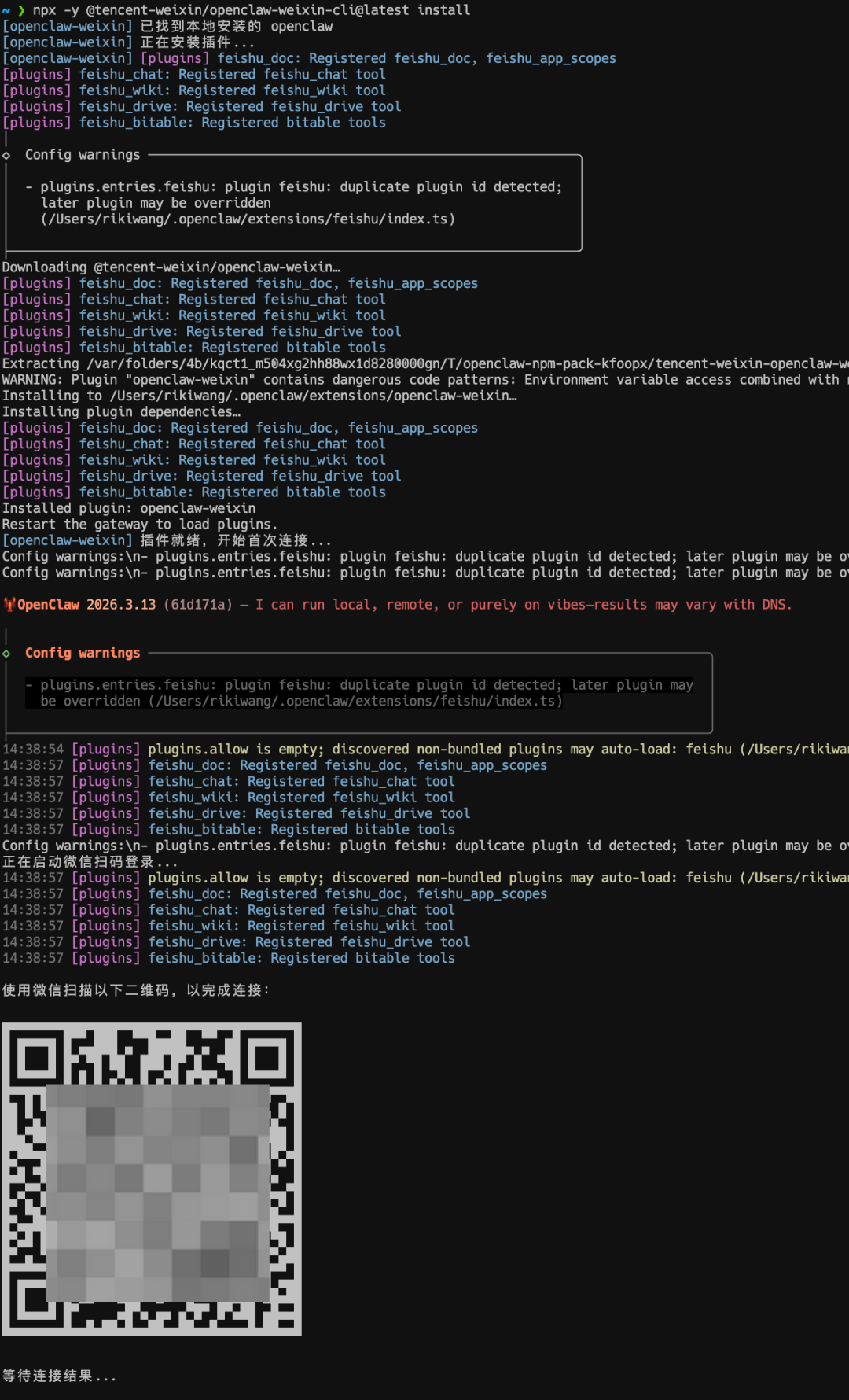

打开微信 ClawBot 插件后,在安装了 OpenClaw 的电脑上执行以下命令:

npx -y @tencent-weixin/openclaw-weixin-cli@latest install命令执行后会生成一个二维码,使用微信扫描该二维码完成配对。

配对成功后,你就能在微信内与 OpenClaw 进行交互。

3. 功能现状评估

根据我的实际测试,微信 ClawBot 目前的功能特性如下:

| 功能 | 支持情况 | 说明 |

|---|---|---|

| 文本对话 | ✓ 支持 | 核心功能,运行稳定 |

| Markdown 格式 | ✗ 不支持 | 微信内仅支持纯文本显示,对格式化需求不高的场景可接受 |

| 文件读取 | ✓ 支持 | 可上传 PDF 等文件,OpenClaw 能正确解析内容 |

| 文件发送 | ✗ 不支持 | 暂无法从 OpenClaw 向微信发送本地文件 |

| 语音输入 | ✓ 支持 | 可发送语音消息,OpenClaw 能识别并理解 |

| 语音输出 | ✗ 不支持 | 暂不支持语音回复 |

功能限制可能与插件版本有关,后续迭代可能会改进。

四、故障排查

在操作过程中如遇到报错或异常,建议:

- 确认 Node.js 版本是否符合要求

- 验证 API Key 和 App Secret 是否正确复制(注意空格和特殊字符)

- 检查飞书/微信应用的发布状态是否为"上线"

- 查看本地防火墙是否阻止了相关端口通信

- 将完整错误信息反馈到相关社区或提交给 AI 助手分析

总结

从产品经理的角度看,OpenClaw 提供了一个相对轻量的本地 LLM 对话部署方案,它的价值在于:

- 多渠道支持:可同时接入飞书、微信等多个平台,无需重复开发

- 本地可控:模型和数据在本地运行,避免隐私泄露风险

- 快速迭代:插件和功能更新频率较快,持续补充缺失的能力

但需要注意的是,当前版本在微信端的功能还不够完善(如文件发送、Markdown 支持等),适合作为早期体验版本,不建议直接用于生产环境。

如果你对 AI 对话框架感兴趣,或想探索本地部署的可能性,这套方案值得尝试。