MiniMax 最近推出了 M2.7 模型,号称支持"AI 自我迭代",在代码和推理任务上表现优秀。本文将详细介绍如何将 MiniMax M2.7 接入 WorkBuddy,全程只需 5 分钟配置。

MiniMax M2 系列模型介绍

MiniMax 是国内领先的 AI 公司,M2 系列是其最新旗舰模型线。主要型号包括:

M2.7(推荐日常使用)

- 最新旗舰,支持"AI 自我迭代"

- 204K 上下文

- 代码、推理、长文本均衡能力强

- 支持 Tool Call,输出约 60 TPS

M2.7-highspeed(高频对话首选)

- 极速版,204K 上下文

- 效果与 M2.7 一致,输出约 100 TPS

- 适合对响应速度敏感的场景

M2.5/M2.5-highspeed(省钱之选)

- 均衡性价比,204K 上下文

- 价格比 M2.7 更低

- 适合批量任务和非旗舰预算场景

统一 API 地址:所有模型完全兼容 OpenAI 格式,换 Key 换 URL 就行。https://api.minimaxi.com/v1/chat/completions

WorkBuddy 接入 MiniMax 教程

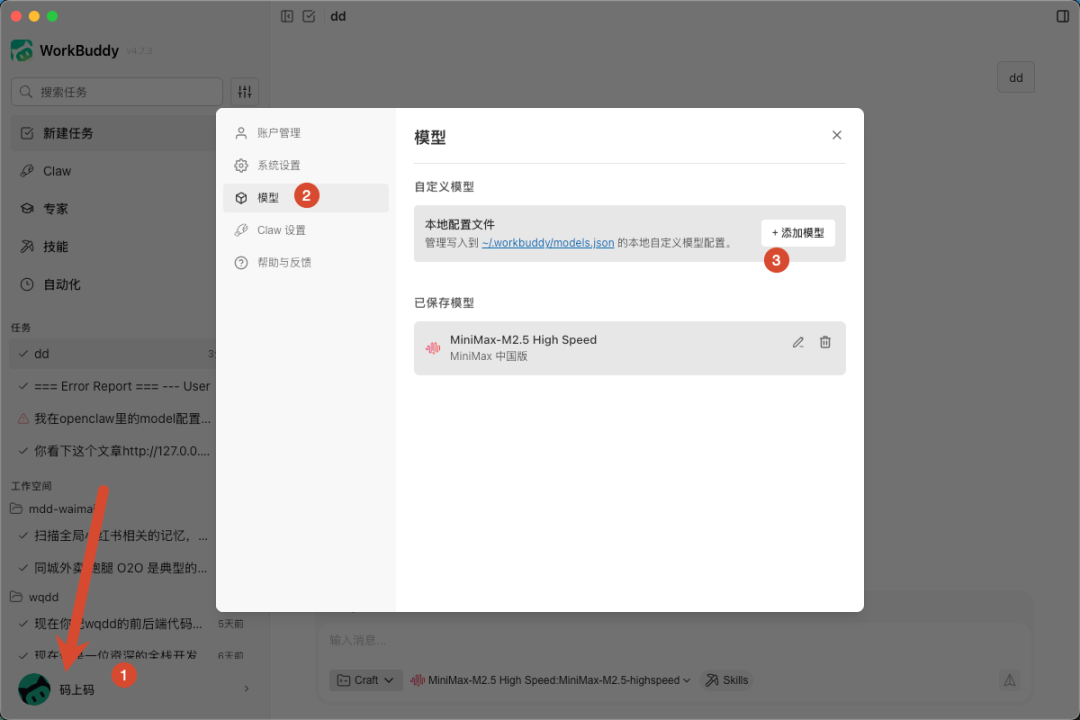

- 打开 WorkBuddy 设置

点击左下角头像里的 Claw 设置,然后点击模型 → 添加模型。

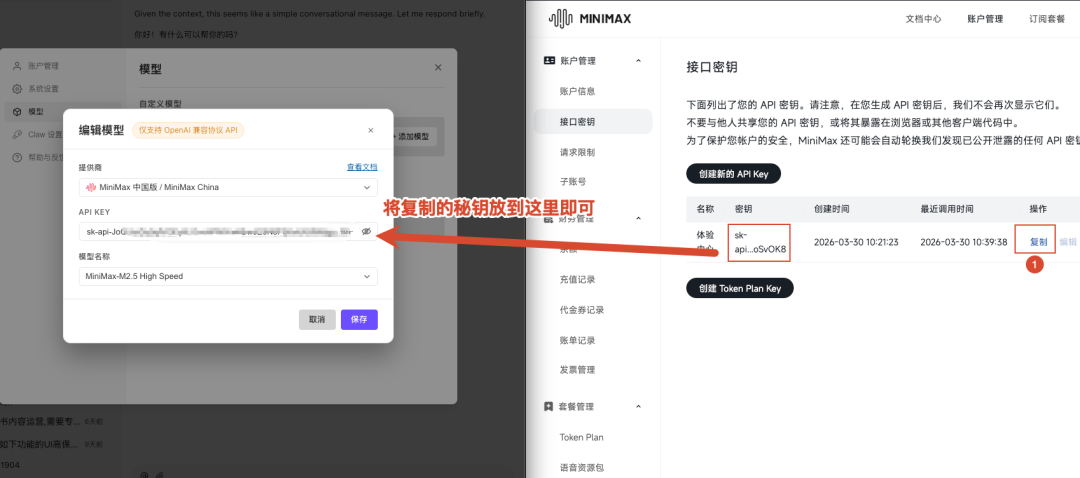

- 添加 MiniMax 模型配置

打开 MiniMax 账户管理,点击接口秘钥,把秘钥复制到 WorkBuddy 编辑模型的弹出框里。

注意:如果直接修改 models.json 配置,apiKey 和 url 每个模型都要填,不能省略。两个模型可以共用同一个 API Key,只要 id 和 name 不同就行。

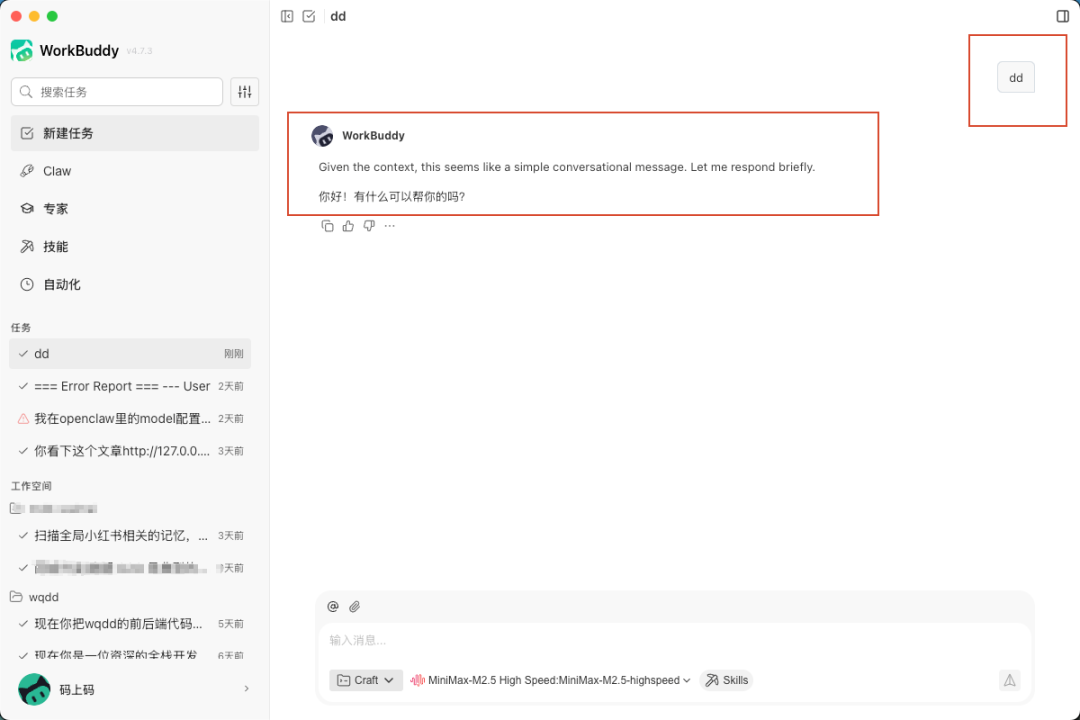

- 重启 WorkBuddy 并切换模型

建议完全退出再重新打开 WorkBuddy(macOS 用户右键 Dock 图标选「退出」)。重启后在对话框左下角切换到 MiniMax M2.7,发一条消息验证。

⚠️ JSON 格式严格:最后一个对象后面不能有多余逗号,Key 必须双引号包裹,否则模型不显示且无任何报错提示。

实测体验

接入后使用 M2.7 跑了几个常用场景:

1. 代码生成和 Review

Java 代码写得不错,给了一段 Spring Boot 的 Service 层让它 Review,指出了两处线程安全隐患,比某些国产模型只会给"建议加注释"要强。

2. 长文本处理

204K 上下文实测塞了一份 6 万字技术文档让它总结,没有截断,摘要准确,这对架构评审文档处理很实用。

3. Tool Call 支持

在 WorkBuddy 和 OpenClaw 里用到工具调用的场景(比如搜索、文件读取),M2.7 的 Function Calling 格式兼容正常,没出现 JSON 格式乱掉的问题。

价格方面:MiniMax 目前新用户有免费额度,日常体验足够了。如果觉得好用,M2.5 是更省钱的平替,日常对话场景感知不到差距。

小结

整个接入过程比预期简单很多,核心就两件事:

- API Base URL 填

https://api.minimaxi.com/v1 - 模型名填

MiniMax-M2.7(或其他 M2 系列型号)

OpenAI 兼容格式的好处就是这样一套接口,换个 Key 和 URL 就能切换到任何厂商的模型。国内的 DeepSeek、MiniMax、通义千问,全都走这条路,以后接其他模型同理。