又来填坑,最近看到1Panel官方分享1Panel应用商店已经支持一键部署OpenClaw,对于自有服务器或NAS非常推荐!

今天就实测部署一下,把整个部署流程整理出来分享给大家。

如果你想用其他方式,建议看看之前分享的OpenClaw教程

操作步骤

第一步:订阅模型与获取API Key

还是要推荐一下这个非常适合新手的按次消耗套餐,最近分享的很多粉丝反馈都很好,不用担心token消耗问题!

我的专属优惠券链接:https://www.aliyun.com/benefit/ai/aistar

进入阿里云百炼后台,在"订阅套餐"中选择Coding Plan。

订阅成功后,从后台复制API Key并妥善保存,后续配置中会多次使用。

第二步:部署OpenClaw

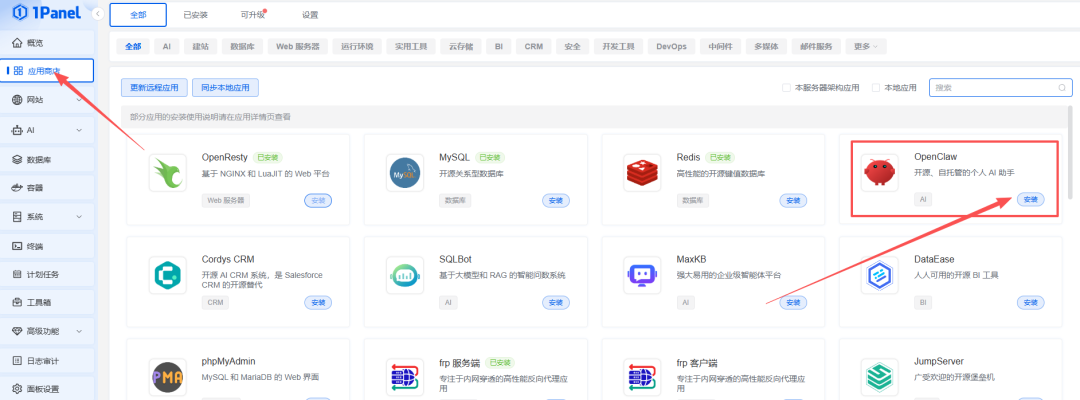

通过1Panel的应用商点直接搜索OpenClaw

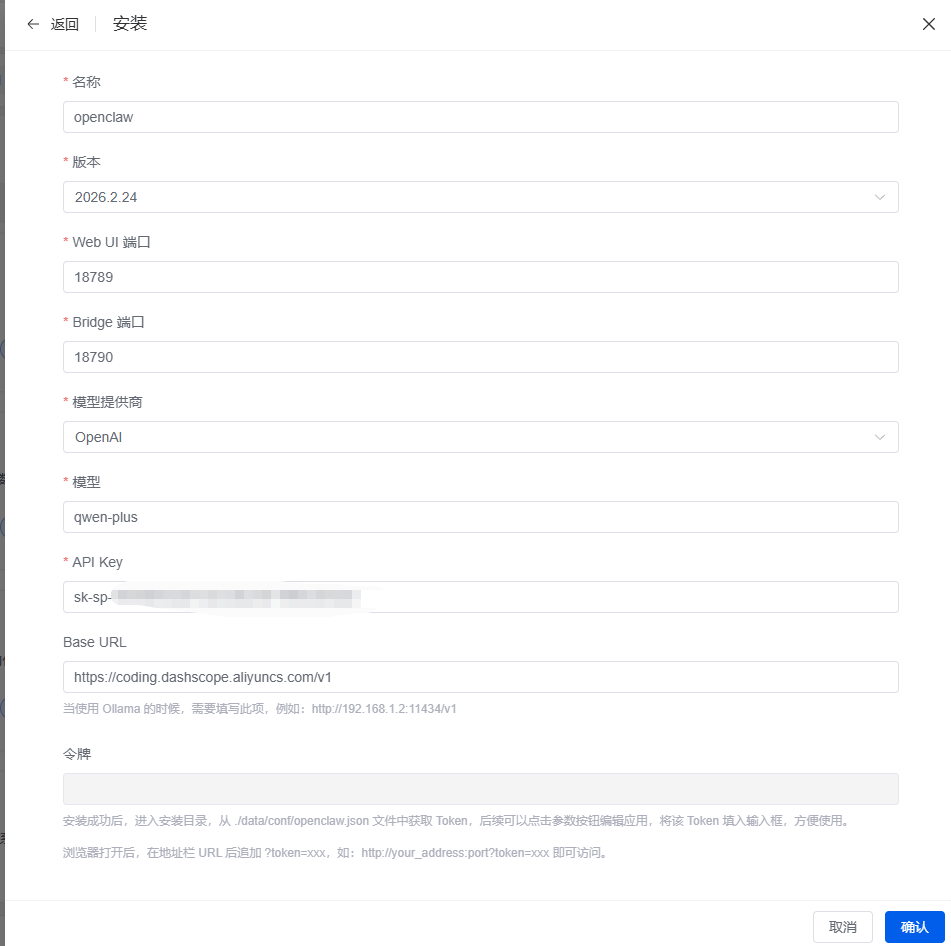

真一键安装,只要填上模型兼容 OpenAI API和API URL:https://coding.dashscope.aliyuncs.com/v1

本机用户可直接访问 http://127.0.0.1:18789/

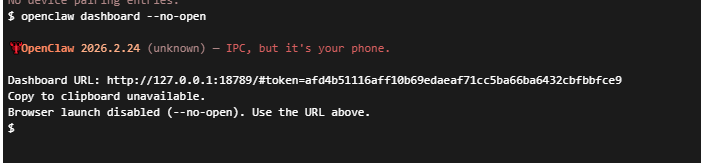

但如果是从其他设备访问部署机器,需在服务器上执行以下命令生成认证Token:

openclaw dashboard --no-open然后使用格式 http://[服务器IP]:18789/#token=[生成的Token] 访问。

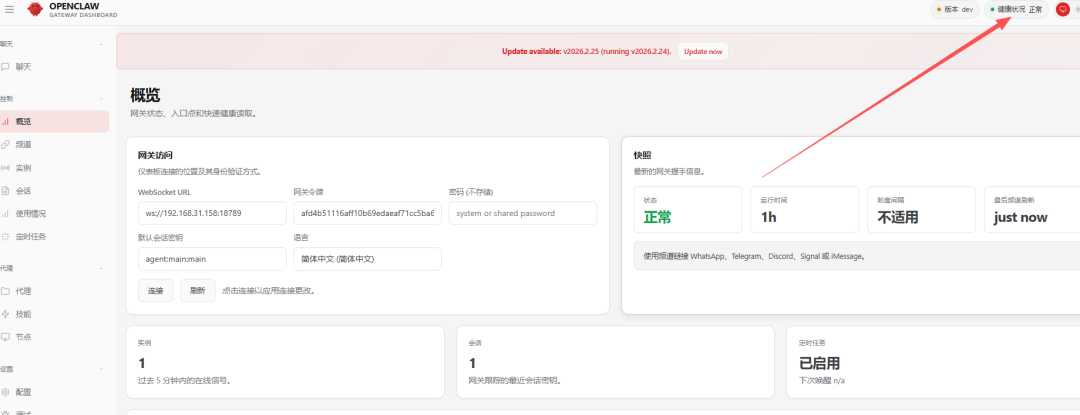

到这里就算配置好了,可以正常访问了

配置补充:因为阿里云百炼支持多模型,所以可以在配置文件修改。

在命令行终端中打开配置文件:

nano ~/.openclaw/openclaw.json下 models 配置(如果已存在则替换)。请将 YOUR_API_KEY 替换为您的 Coding Plan API Key。

"models": {

"mode": "merge",

"providers": {

"bailian": {

"baseUrl": "https://coding.dashscope.aliyuncs.com/v1",

"apiKey": "YOUR_API_KEY",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "qwen3-max-2026-01-23",

"name": "qwen3-max-2026-01-23",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-next",

"name": "qwen3-coder-next",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-plus",

"name": "qwen3-coder-plus",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "MiniMax-M2.5",

"name": "MiniMax-M2.5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 204800,

"maxTokens": 131072

},

{

"id": "glm-5",

"name": "glm-5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "glm-4.7",

"name": "glm-4.7",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "kimi-k2.5",

"name": "kimi-k2.5",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 32768

}

]

}

}

}找到 agents.defaults 对象,并替换或添加以下两个字段:

"model": {

"primary": "bailian/qwen3.5-plus"

},

"models": {

"bailian/qwen3.5-plus": {},

"bailian/qwen3-max-2026-01-23": {},

"bailian/qwen3-coder-next": {},

"bailian/qwen3-coder-plus": {},

"bailian/MiniMax-M2.5": {},

"bailian/glm-5": {},

"bailian/glm-4.7": {},

"bailian/kimi-k2.5": {}

}为什么要多模型,之后多Agent可以根据不同的模型执行不同类型的任务!

第三步:集成搜索工具(可选)

OpenClaw默认使用Brave Search API,但该服务配置较复杂且需绑定支付方式。

作为替代方案,Tavily提供更简洁的集成体验。

集成步骤:

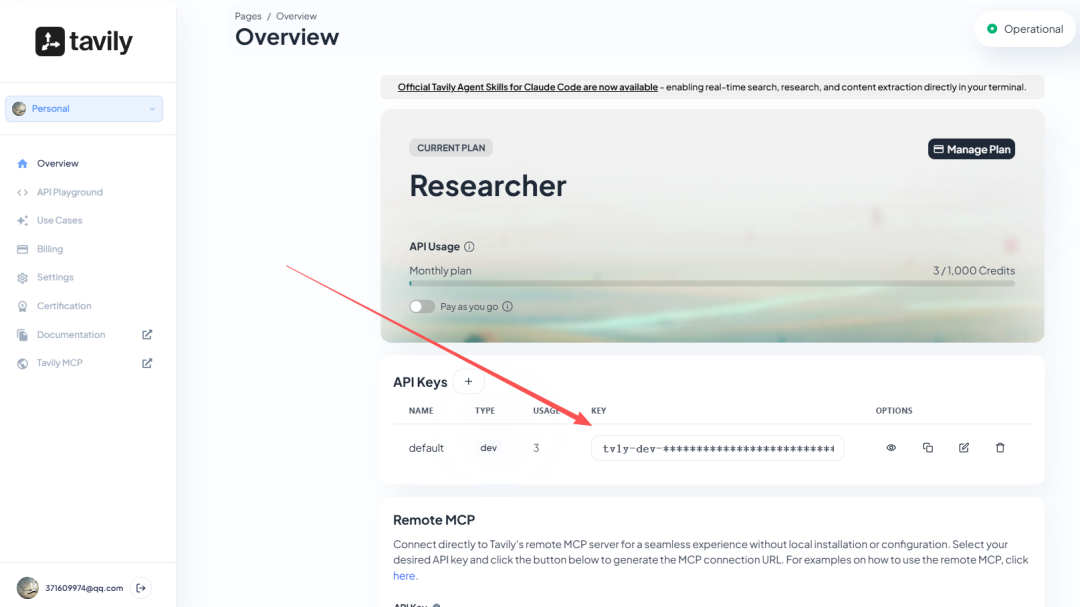

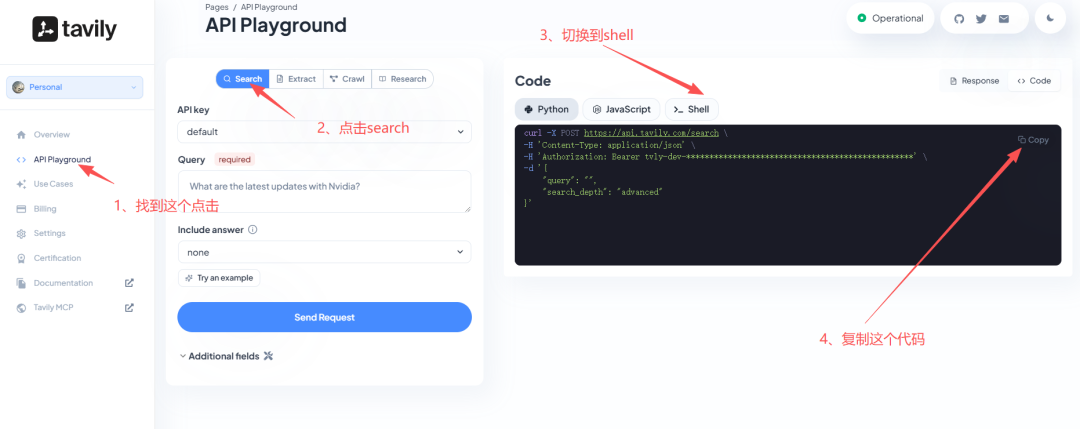

访问 tavily.com 注册账户并获取API Key

在OpenClaw的工具市场中搜索Tavily搜索工具

配置API Key并启用该工具

在提示词中明确指示使用Tavily进行网络搜索,确保工具正确调用

调试建议:首次使用时可能出现工具调用错误,此时通过修改系统提示词来强化工具使用指示,通常能解决问题。

第四步:集成飞书机器人

将OpenClaw接入飞书后,可以实现手机端随时对话,大幅提升使用便利性。

这一步是整个方案中最具实用价值的部分。

飞书应用配置流程:

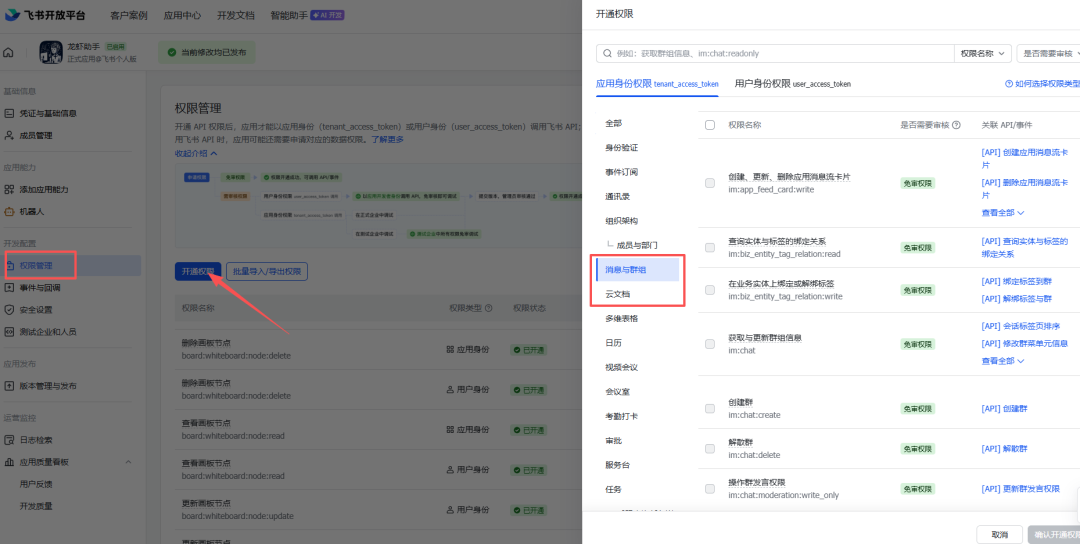

创建或进入应用:在飞书开放平台 → 开发者后台中选择或新建应用

添加机器人能力:在应用详情中勾选"机器人"功能

配置权限:进入"权限管理",开通以下权限组:

消息与群组(用于收发对话消息)

云文档(支持生成和编辑在线文档)

发布应用版本:权限配置完成后,必须先发布应用版本,否则后续配置可能失效

点击"版本管理与发布" → "创建版本"

填写版本号(如1.0.0)和更新说明

保存后点击"申请发布",等待管理员审批(个人企业通常自动通过)

配置事件回调:切换到"事件与回调"标签,选择"使用长连接"方式,添加"接收消息"事件

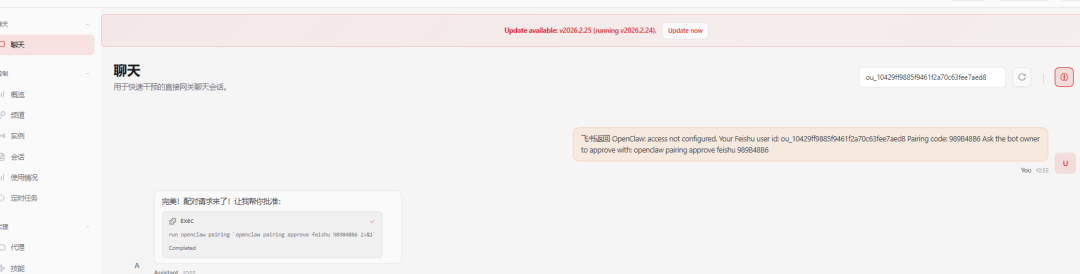

配对流程:

版本发布成功后,进入飞书工作台找到你的机器人

随意发送一条测试消息,获取返回的配对代码

将配对代码提交给OpenClaw完成绑定

过了一会儿,OpenClaw 告诉我配置完成了。

常见问题处理:若修改配置后发现生效不了,务必再次发布新版本。

这是飞书应用的强制要求,不可跳过。

第六步:功能验证

配置完成后,可以在飞书中测试OpenClaw的实际能力。

根据我的测试,让助手完成"整理景点攻略"这类需要网络搜索和文档生成的任务时,系统表现稳定——能够自动创建飞书在线文档并填充内容。

总结

这次实践的核心收获在于:一套可用的AI助手系统,不一定要依赖高端配置或国外服务,国产模型+开源框架的组合同样能提供可靠的能力输出。

从我的角度看,OpenClaw的价值在于它提供了一种相对标准化的智能体部署方案,而Qwen模型的引入则大幅降低了使用成本。飞书的集成进一步打破了"必须打开网页才能用"的局限,让AI助手真正融入日常工作流。

当然,这套方案目前还处于基础阶段。随着使用深入,我计划探索更复杂的任务编排、自定义工具开发等方向。

如果你也对AI工具的实际应用感兴趣,欢迎关注公众号「苏米客」一起交流!