最近这一年,关于端侧 AI 这个话题的讨论越发激烈,手机芯片的 NPU 算力也一路狂飙。上个月谷歌开源的 Gemma 4 模型,因为能直接塞进手机里跑,进一步把讨论推向高潮。

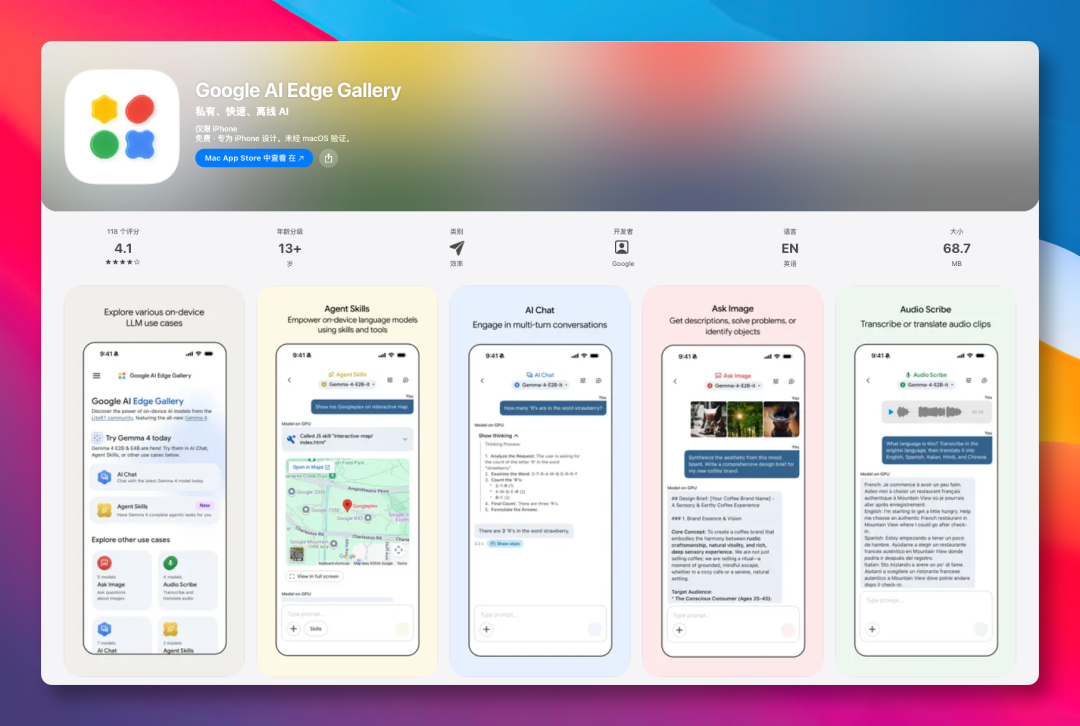

谷歌开源的 Google AI Edge Gallery 是一个能让我们在手机上离线运行各种开源大模型的 App。

目前已拿下 22000+ GitHub Star,支持 iOS 和 Android 系统,模型权重可从 Hugging Face 直接拉取到 App。

所有推理都跑在本地芯片上,全程不联网,数据也不会离开设备。

从定位上,它更像是端侧 AI 的"应用商店 + 模型操场"。

核心功能

AI Chat:基础对话 + Thinking Mode

进到 App 里,第一眼能看到的是 AI Chat 模块,也就是基础对话功能。最近开放的 Thinking Mode 比较有意思,能直接看到模型一步步推理的过程。不过这个特性目前限定部分模型才能开,比如 Google 自家的 Gemma 4 系列就支持。

Gemma 4 里的 E2B、E4B 命名挺有意思,这里的 E 是 Effective 的缩写,意思是用了优化技术,让 4B 参数发挥出更大模型的水平。

Ask Image:拍照问图

第二个常用功能是 Ask Image,也就是拍照问图。调用相机或相册图片,让本地模型识别物体、解题、做 OCR 都行。随时随地拍照翻译、未知事物拍照询问、甚至分析图片信息特征,这类场景都可以使用。

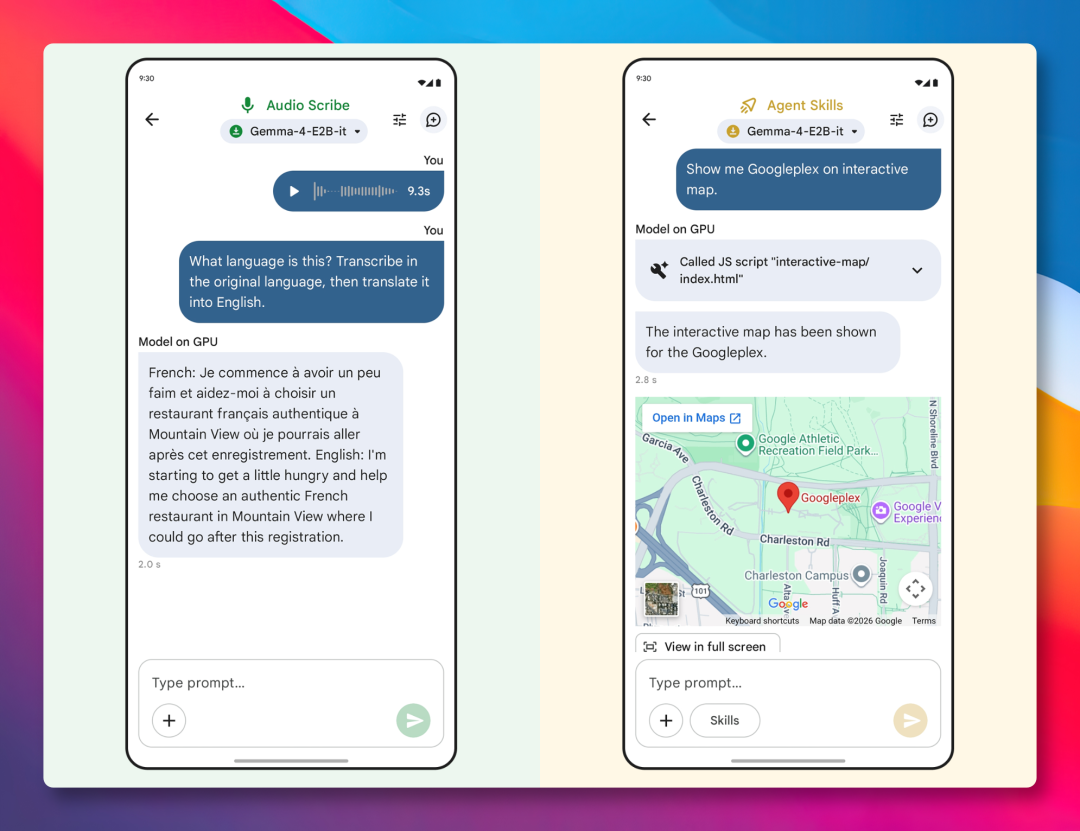

Audio Scribe:语音转写与翻译

Audio Scribe 专门处理语音转写和翻译。录一段会议或讲座,本地直接出文字稿,还能跨语言翻译。在飞机上、地铁这类没网或弱网环境下,刚好可以派上用场。

Agent Skills:给本地模型挂载外部工具

第四个比较硬核的是 Agent Skills,给本地模型挂载外部工具。借助这个特性,模型可以接维基百科查事实、调地图查位置、生成可视化卡片等等能力。更妙的是支持从 URL 远程加载技能模块,社区里也有不少现成的可以直接用。

模型管理:从 Hugging Face 加载自定义模型

模型管理模块支持从 Hugging Face 加载自定义模型,查看每个模型基准测试跑分,自由选择安装到手机,还能够精细调温度、top-k 这些参数。

安装与使用

整个安装过程基本没什么门槛:

- iPhone 设备:直接到 App Store 搜"Google AI Edge Gallery"安装即可

- 安卓设备:在 Google Play 同样能找到,没 Google Play 的可以去 GitHub Releases 下载 APK 包

安装完成打开 App,选模型下载就完事,每个模型大约 2-4GB,下载时间稍长需要耐心等下,之后所有操作均在本地进行。

机型建议:

- iPhone 15 Pro 及以上:可选 E4B

- iPhone 14 Pro:选择 E2B

- 安卓手机:推荐 8GB 内存以上的旗舰机

客观评价

当然,这个项目也有几个点需要客观说一下:

- 端侧小模型有上限:复杂 Agent 工作流目前还是云端大模型更稳

- 老机型性能问题:跑大一点的模型容易卡顿发热,建议先从 E2B 小模型试起

- Beta 阶段:还处在 Beta 阶段,偶尔遇到小 bug 不奇怪,遇到了可以到 issue 上反馈

总结:端侧 AI 的起点信号

看完这个项目之后,最直观的感受是:端侧 AI 这件事,真的开始能用了。而 Edge Gallery 在这场变化里的位置,比它本身的功能更值得关注。

过去两年,本地跑大模型这件事,电脑端早就有 Ollama、LM Studio 这些工具铺路。但到了手机端,一直停留在开发者圈层,普通用户基本进不来。而谷歌官方下场做这么一个 App,把"挑模型 - 下载 - 跑起来"简单到只需点击几次。

苏米注:这是手机端本地大模型第一次长出消费级的入口形态。这件事的意义,不只是省钱或者保护隐私,而是 AI 正在从云端的某个数据中心,搬进每一部口袋里的设备。

当全球十几亿台手机都能离线跑模型时,AI 变成跟相机、地图一样的基础能力。实时翻译、随手解答、本地处理隐私文件,这些过去要联网才能做的事,未来都可以离线完成。而 Edge Gallery 的出现,可能就是这件事的起点信号。

GitHub 项目地址:https://github.com/google-ai-edge/gallery

App Store:搜索"Google AI Edge Gallery"

Google Play:搜索"Google AI Edge Gallery"