每天早上睁眼,第一件事就是把十几个 App 全部刷一遍。微博热搜、知乎热榜、抖音热门、B站推荐、百度热搜,每个平台的规则都不一样,算法推荐还夹一堆垃圾信息。想搞清楚「今天到底发生了什么」,得在十几个产品之间来回跳,半小时过去了,除了信息焦虑什么都剩不下。

做自媒体的更辛苦。选题靠刷热搜,竞品监控靠手动搜,行业动态靠人肉盯,大量时间耗在「信息收集」上,真正用来创作的时间反而被压缩得很厉害。

市面上的舆情监控工具不是没有。新榜、清博指数等功能确实成熟,但定价面向大企业,一年几万到几十万是常态。个人开发者和中小团队基本用不起。免费工具也有,但要么平台覆盖不全,要么数据延迟严重,要么干脆把使用数据拿去卖了。

有没有一款工具,能免费、实时、而且主动把热搜推到你手边?

TrendRadar:热点感知 + 推送管道

TrendRadar,GitHub 56k Star,专门做这件事。本质上是一个「热点感知 + 推送管道」系统,从 35 个主流平台持续抓取热榜数据,按配置的关键词做筛选,通过指定渠道主动推送。整个流程全自动,部署完配好关键词和推送地址,剩下的事它全帮你搞定。

核心功能

35 个平台覆盖基本打透了中文互联网流量高地。知乎、微博、抖音、B站、百度、头条等大众平台都在,还有财联社、华尔街见闻等财经媒体,以及 V2EX、掘金、GitHub Trending 等开发者社区。不需要一一对接各平台 API,这件事它已经做完了。

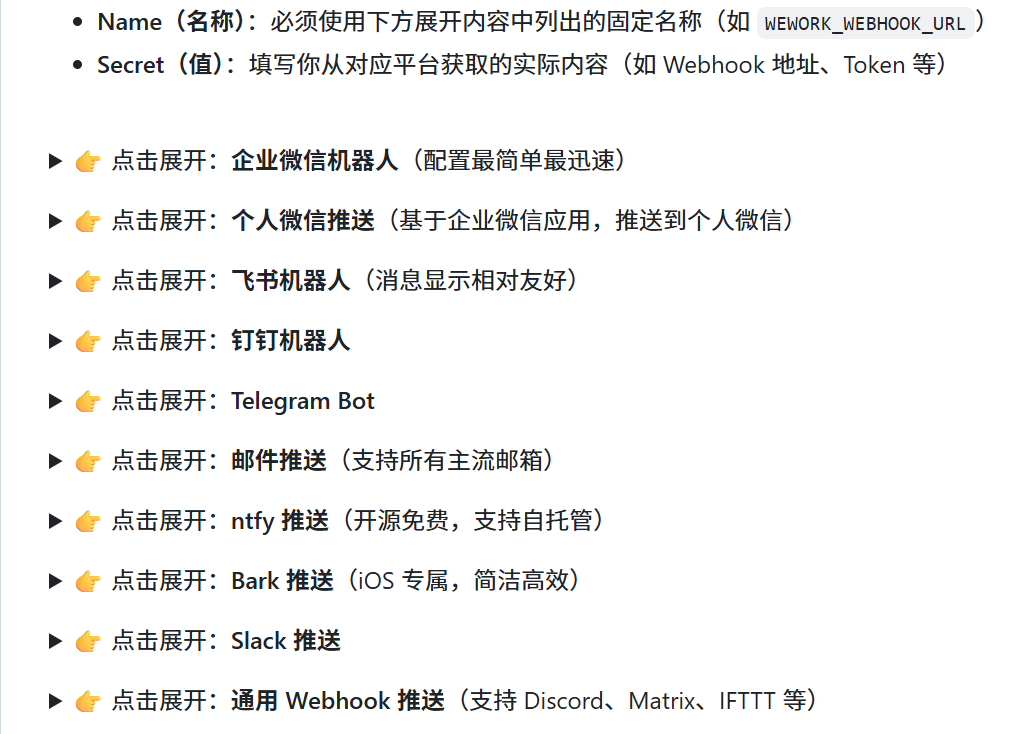

7 种推送渠道,可同时开启。微信(企业微信和个人微信都行)、飞书、钉钉、Telegram、邮件、ntfy,基本上能想到的通知方式都支持了。

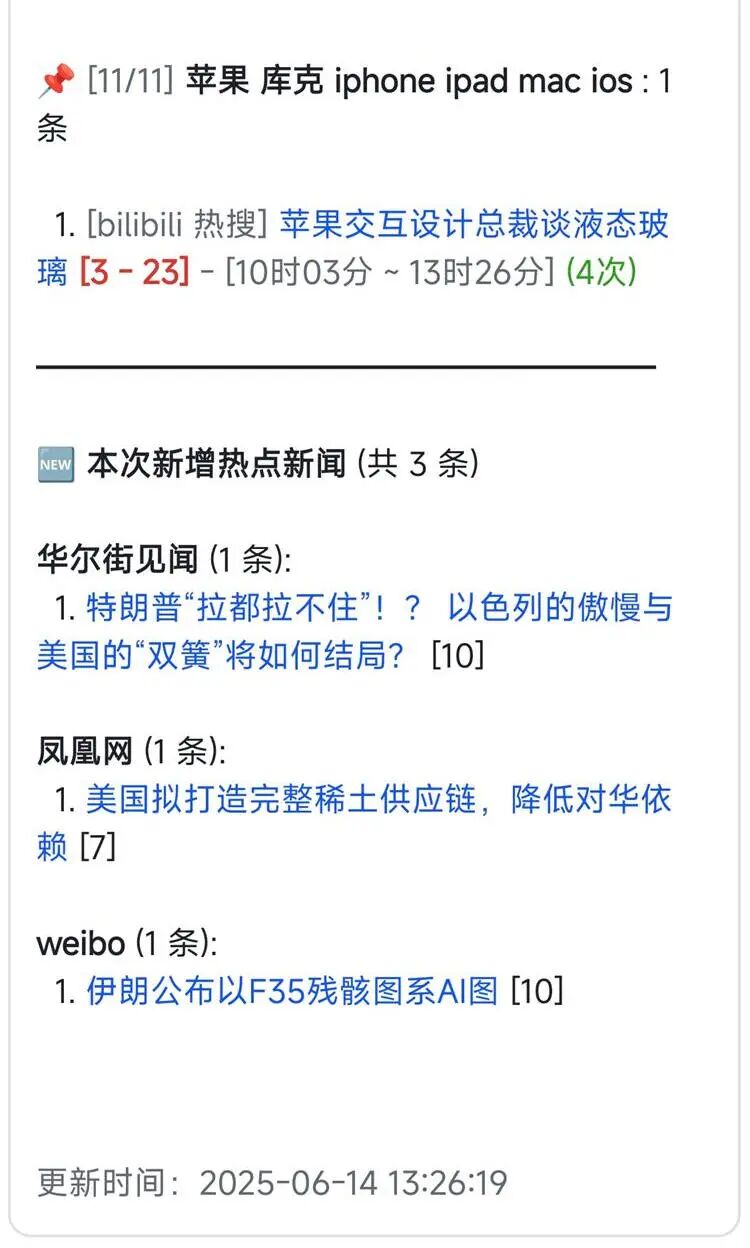

三种推送模式设计实用:

- 每日汇总:适合早上看全天热点总结

- 当前榜单:适合实时监控

- 增量监控:只推新内容,不会重复轰炸

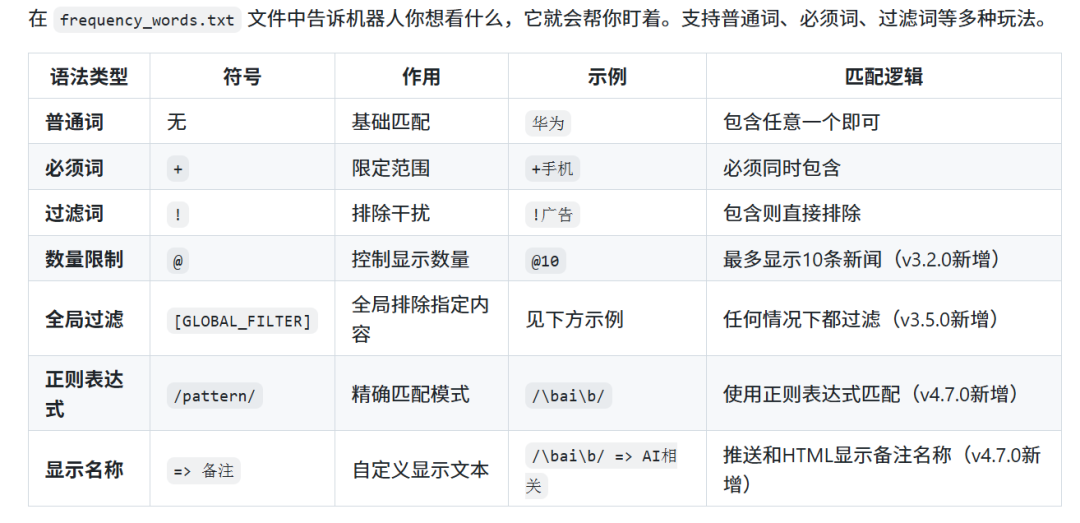

关键词系统支持细粒度控制:必须词(+)、过滤词(!)、数量限制(@)。只想看同时包含「AI」和「开源」的内容?+AI +开源 搞定。想过滤广告和低质内容?!广告 !推广 就行。

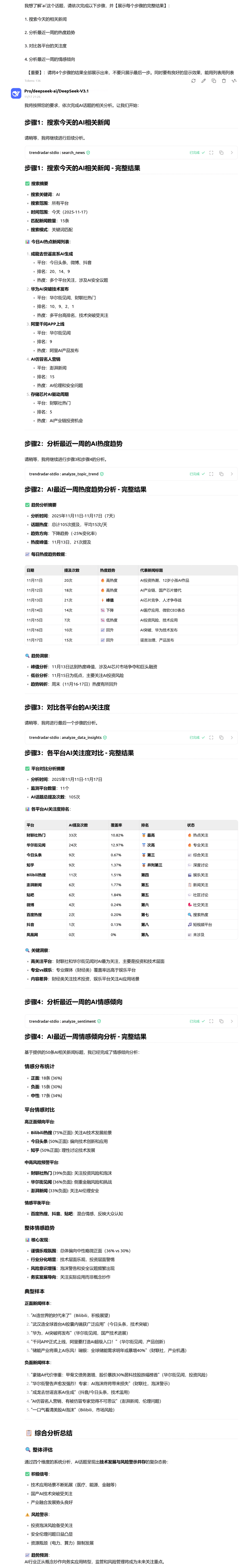

MCP 模块(v3.0 新增)是重点更新。TrendRadar 现在可以被 AI Agent 直接调用,通过 Claude Desktop、Cherry Studio、Cursor 等支持 MCP 的客户端,用自然语言对话:「分析一下比特币近两周的热度趋势」「查昨天知乎上关于 AI Agent 的所有讨论」。13 种内置分析工具把原始数据变成可读结论。

技术架构

整体是爬虫 + 分析 + 推送管道架构,核心代码 Python 占 90% 以上。

数据采集层调用 newsnow 项目的 API 拿到原始热榜数据,经过关键词筛选后进分析引擎。引擎内有一套可调权重的排序算法:排名权重 60%、频次权重 30%、热度权重 10%,比例可以在配置文件里自己调,决定它是偏「追实时」还是偏「挖深度」。

存储层支持 SQLite 本地和 S3 远程两种模式,Docker 部署默认走 SQLite,GitHub Actions 跑自动切 S3。

推送层做了统一分发器(NotificationDispatcher),新增渠道只需实现一个接口,不用改核心代码。目前 7 种渠道都是 Webhook 驱动,配一个 URL 就能跑。

MCP 模块把整个项目变成了 AI Agent 的「眼睛」,这个功能在同类项目中做得最完整。

三种部署方式

省事:GitHub Actions

Fork 到自己的 GitHub 仓库 → Settings → Secrets 里填推送渠道的 Webhook 地址 → 手动跑一次 Action 测试 → 设置定时触发 → 开启 GitHub Pages 查看网页报告。全程不用装任何东西,GitHub 免费额度完全够用。

有服务器:Docker

docker run -d --name trend-radar \

-v ./config:/app/config:ro \

-v ./output:/app/output \

-e FEISHU_WEBHOOK_URL="你的飞书webhook" \

-e CRON_SCHEDULE="*/30 * * * *" \

wantcat/trendradar:latest镜像是 wantcat/trendradar,数据持久化到本地 ./output 目录。

深度自定义:本地运行

git clone 项目

cd TrendRadar

pip install -r requirements.txt

cp config/config.yaml.example config/config.yaml

# 编辑 config.yaml 配置关键词和推送渠道

python main.py开源协议

本项目遵循 GPL-3.0 协议。GPL 和 MIT、Apache-2.0 有本质区别:具有「传染性」。如果修改了源码并且分发给他人(哪怕是以在线服务的形式),修改部分也必须开源。

对普通使用者来说影响基本为零——只是 Fork 过来配关键词跑推送,没改代码也不对外分发,GPL 没有任何额外约束。需要注意的场景是做成 SaaS 服务卖给别人,就需要把改动开源了。

使用流程

部署完主要就是三件事:

选平台:config.yaml 里把想监控的平台前面的注释去掉就行。

写关键词:frequency_words.txt 里写你关心的话题,每行一组,空行分隔不同主题。

填推送地址:以飞书为例,去飞书开放平台创建一个自定义机器人,拿到 Webhook URL 填到环境变量里就行。

跑起来之后,会拉一次全量数据,之后就是增量更新。可以在 GitHub Pages 上看到自动生成的网页报告,按平台分类展示所有命中关键词的热点内容,点击就能跳到原始链接。

如果接了 MCP,体验会更进一步。打开 Cherry Studio 或 Claude Desktop,配置好 TrendRadar 的 MCP Server 地址,就可以直接用自然语言问问题了。

适用场景

| 用户群体 | 核心价值 |

|---|---|

| 自媒体运营者 | 自动监控 35 个平台,匹配关键词直接推送到微信,省下来每天刷热搜的时间够多写一篇稿子 |

| 投资者和行业研究员 | 热度走势分析,哪个话题在持续发酵一目了然,增量推送 + 时间窗口控制不会漏信息也不会半夜吵醒 |

| 小团队公关和市场部门 | 关键词监控 + 多平台覆盖 + 自动推送,日常舆情监测基本需求都能满足,是商业舆情 SaaS 的平替 |

| 技术爱好者 | MCP 模块把热点数据接进 AI Agent 工作流,让 Agent 自动判断新闻是否值得跟进、自动生成简报 |

总结

TrendRadar 在「免费」这个前提下做到了惊人的完整度。56k Star 不是白来的——35 个平台覆盖、7 种推送渠道、三种运行模式、MCP AI 增强,这些功能放在任何一个商业化产品里至少卖几万块一年。

当然它也不是完美的。数据依赖第三方 API,如果上游挂了它也会跟着出问题,这是所有聚合类项目的通病。另外对完全没有技术背景的人来说,配置 Webhook 和编辑 YAML 还是有门槛的。

但瑕不掩瑜。如果你每天花在刷热搜找素材上的时间超过 30 分钟,这个项目值得你花 30 分钟部署一下。

苏米注:对于自媒体运营者来说,TrendRadar 解决的是一个高频刚需——信息收集。自动监控 + 主动推送的模式,把原来需要手动刷十几个 App 的工作自动化了。结合 MCP 模块还能让 AI Agent 直接调用热点数据,想象空间很大。