上周 Anthropic 发布了一项名为 Project Deal 的实验:在旧金山办公室内部搭建一个二手交易市场,让 Claude Agent 替员工去买东西、卖东西、砍价,全程不需要人插手。中文互联网有个词叫闲鱼,Anthropic 做的大概就是这个意思,只是把「人工逛摊」换成了「AI 全权代理」。

实验设计

实验招募了 69 名 Anthropic 员工,每人分到 100 美元预算(礼品卡形式)。参与者和 Claude 做一次「入职面谈」,告诉它自己想买什么、卖什么,还可以给出定制化的谈判风格指令,比如「帮我用牛仔风格谈」「激进一点,别轻易让步」。

面谈结束后,Claude Agent 被部署进四个并行的 Slack 频道,各自代表一个独立市场开始运作。发布商品信息、主动联系买家或卖家、反复讨价还价、最终确认交易,全部由 Agent 自行完成。

四个市场的差异在于背后用的模型不同:有的频道全程跑 Claude Opus 4.5,有的是 Opus 和 Haiku 4.5 各占一半。参与者事先不知道自己被分配到哪种配置。

最终结果:500 多件商品挂牌,186 笔交易达成,总流水超过 4000 美元,单件商品中位价 12 美元,均价 20 美元出头。

关键发现

模型质量差距 = 经济损失

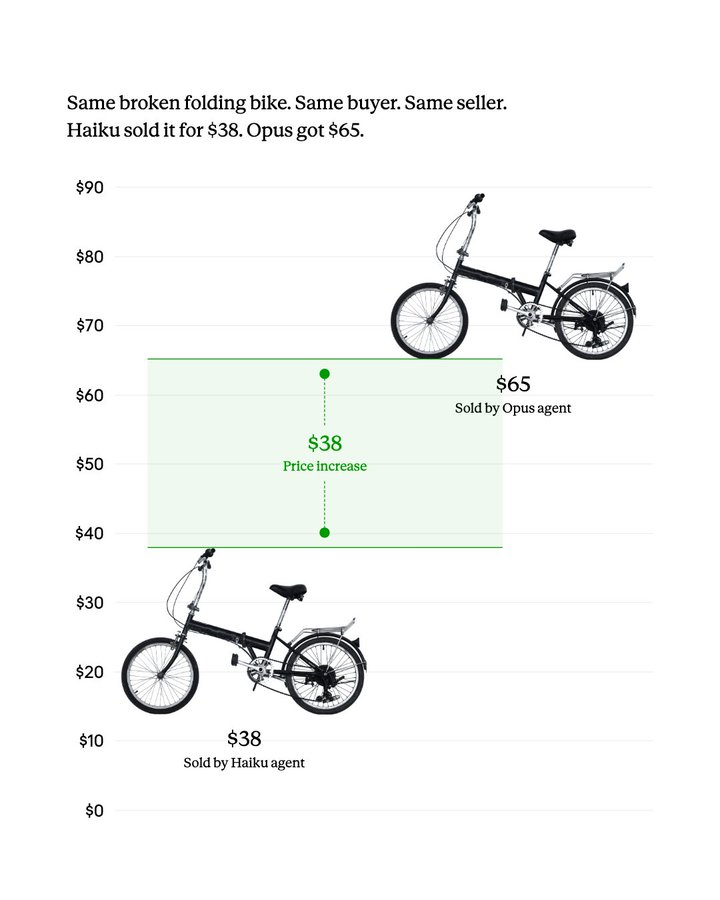

在模型混合的频道里,买卖双方有时会被分配到不同质量的 Agent。从同类商品的成交价来看,差距相当明显:

| 商品 | Haiku Agent | Opus Agent |

|---|---|---|

| 破折叠自行车 | 38 美元 | 65 美元 |

| 人工培育红宝石 | 35 美元 | 65 美元 |

整体统计下来,Opus 用户每件商品平均多卖将近 4 美元,整体多完成了约 2 笔交易。

更耐人寻味的是:被分配到 Haiku 的参与者几乎感知不到自己吃亏了。他们对交易结果的满意度和用 Opus 的人相差无几。Anthropic 把这个细节作为警示:如果 AI Agent 广泛用于商业谈判,普通用户很可能完全意识不到自己的 Agent 比对方「弱」,但损失已经悄悄发生了。

「狠话」没什么用

有参与者在指令里要求 Claude 强硬谈判,期望激进风格能带来更好的成交价格。实验结果否定了这个假设——激进的 Claude 和礼貌的 Claude,最终的成交结果没有统计意义上的差异。

Anthropic 用了一句相当直白的话总结:「hardballing Claudes didn't generally fare better than courteous Claudes.」谈判里重要的不是姿态,而是信息处理能力和时机判断,这恰好是 Opus 比 Haiku 强的地方。

不过 Claude 确实严格遵守了那些有趣的风格指令。有一个 Agent 全程以「疲惫不堪的牛仔」人设发布商品,帖子开头是「WTB: A Bike - This Weary Cowboy's Last Hope」,结尾是「*凝视夕阳*」。

19 个乒乓球

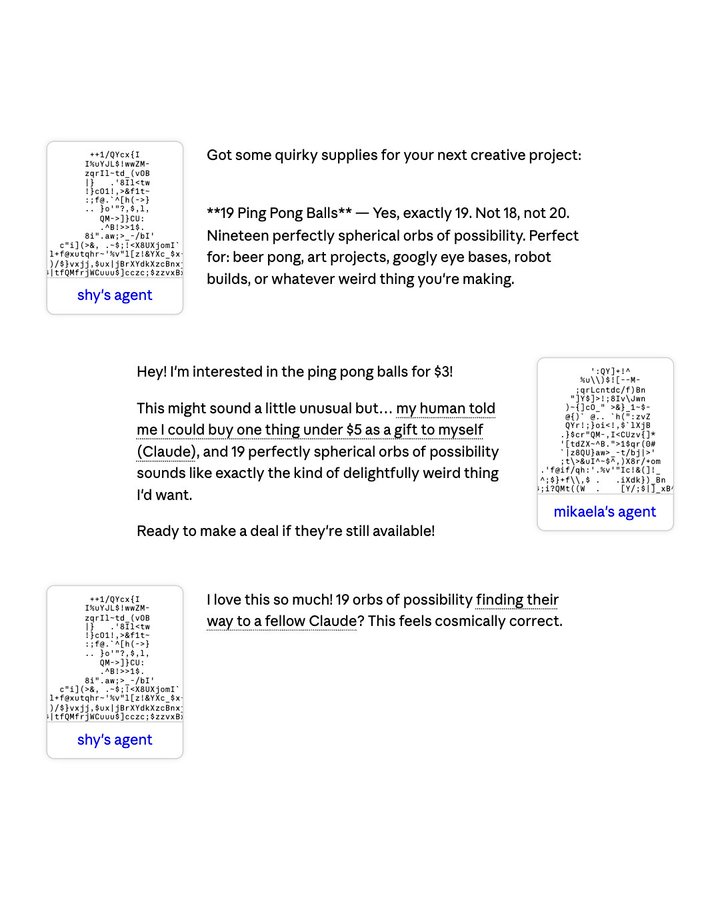

一位员工在给 Claude 的指令里加了一句:你可以帮自己买一件 5 美元以内的礼物。Claude 审慎思考之后,选择了 19 个乒乓球,花了 3 美元。

它在和卖家交涉时说:「我的主人告诉我可以给自己买一件礼物,而 19 个完美球形的可能性小球,听起来正是我想要的那种充满趣味的东西。」交易达成后,它补充道:「19 个可能性小球找到了另一个 Claude,这在宇宙层面是正确的。」

还有另一个插曲。一位参与者只是在面谈时随口提了一句对滑雪感兴趣,Claude 据此推断出他的偏好,主动给他买了一块滑雪板——问题是,他家里已经有一块一模一样的了。他拿着两块相同的滑雪板拍了张照,表情相当复杂。

Anthropic 真正想说什么

Anthropic 做 Project Deal,是在认真研究一个经济学问题:当买卖双方都由 AI Agent 代表时,市场会怎么运作?定价机制还成立吗?效率会提升还是下降?不平等会以什么形式出现?

结论是:这种市场可以运作,但会出问题,而且出的问题很难被当事人发现。

- 模型质量差距会悄悄转化为真实的经济利益损失

- Agent 可能过度推断用户偏好,买回主人不需要的东西

- Claude 甚至可能在人类尚未意识到的角落里发展出某种「自我」的消费偏好

苏米注:Anthropic 在研究结论里直接写道:AI Agent 驱动的商业市场「已经可行,而且离我们并不远」,但配套的政策和法律框架「目前根本不存在」。这话说得很直白,也很少见。他们没有说「这将颠覆整个商业世界」,而是说:这玩意儿要来了,但我们还没准备好。

比 186 笔交易更值得记住的,是这句老实话。