作为一个长期研究AI开发提效的从业者,我发现了一个有趣的现象:当下最高效的AI能力落地,往往不在于某个单一工具有多强大,而在于如何让结构化的指令系统与AI的理解能力完美适配。

最近体验的飞书CLI工具就是这样一个案例

它不仅解决了传统客户端的体验问题,更重要的是通过Skills系统为AI Agent提供了精准的行动框架。

这让我意识到,命令行接口与AI的结合,可能是提升工作流自动化的关键突破口。

核心问题:传统客户端的低效痛点

长期使用飞书桌面客户端的用户应该有共鸣:在M1 Mac等设备上,启动延迟、登录态失效、同步阻塞是常见困扰。

这些看似微小的交互问题,在日常工作中累积起来就是大量的非价值时间消耗。相比之下,命令行界面的轻量化特性和直接指令执行机制,提供了完全不同的体验路径。

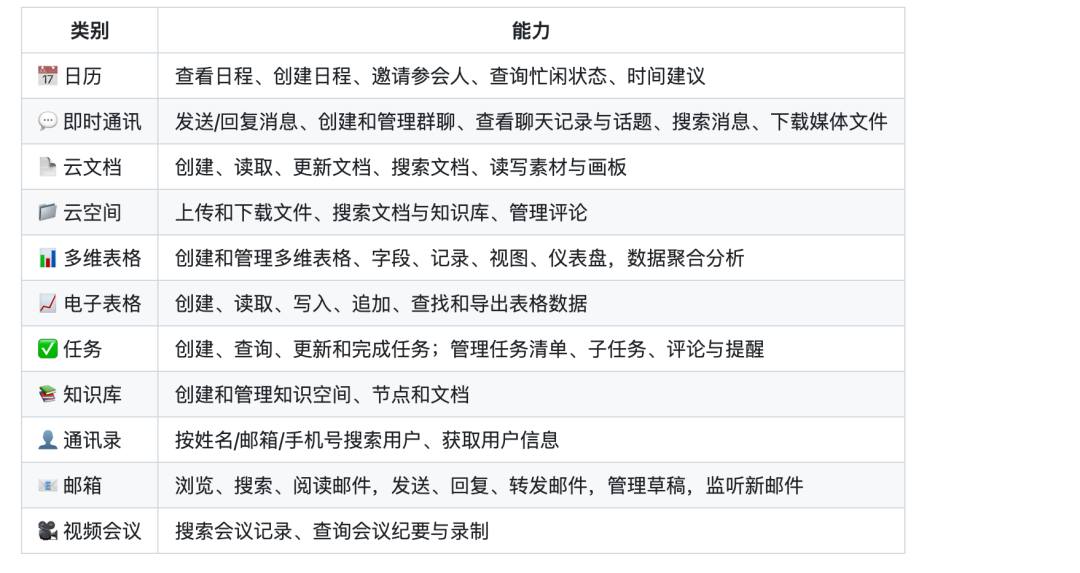

飞书CLI的功能覆盖范围

飞书官方推出的lark-cli工具采用了11个业务域、200+命令的规模设计,覆盖日程、消息、文档、表格等核心工作场景。以下是常见操作的命令示例:

| 操作类型 | 命令示例 | 应用场景 |

|---|---|---|

| 发送消息 | lark-cli im +messages-send --chat-id "oc_xxx" --text "内容" |

自动化通知、定时提醒 |

| 创建文档 | lark-cli docs +create --title "标题" --markdown "内容" |

自动生成报告、会议纪要 |

| 查看日程 | lark-cli calendar +agenda |

日程检索、冲突识别 |

| 数据写入 | 多维表格/电子表格数据操作 | 自动化数据收集与统计 |

三层调用架构设计

飞书CLI采用分层架构,针对不同用户场景提供递进式的操作复杂度:

- 第一层:快捷命令(Shortcuts) — 以"+"开头的人类友好命令,内置智能默认值,支持

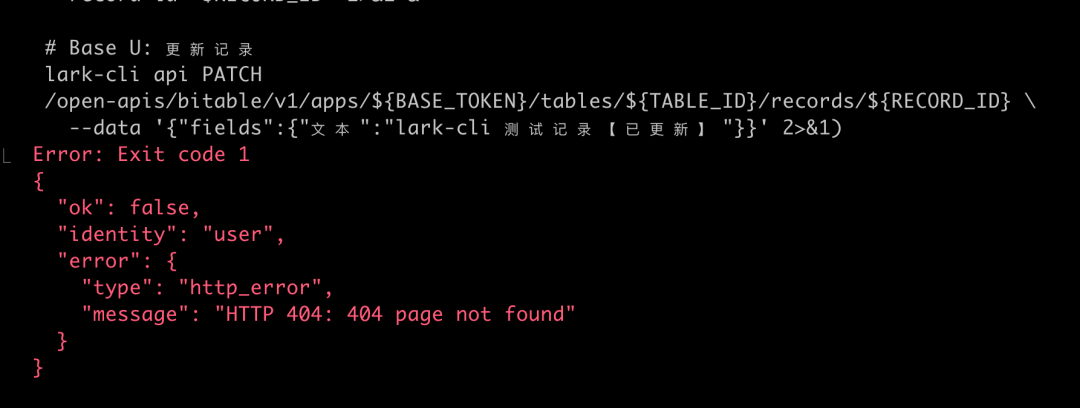

--dry-run预览模式,降低误操作风险。适合日常高频操作。 - 第二层:API命令 — 从飞书开放平台OAPI元数据自动生成的100+精选命令,与平台端点一一对应。适合需要精细参数控制的场景。

- 第三层:通用API调用 — 直接调用飞书2500+个开放平台端点的能力。适合非标准化、高定制需求的场景。

这种设计的优势在于:使用者可根据操作复杂度灵活选择,避免过度设计或功能不足的问题。

AI Agent的核心突破:Skills系统

相比人类用户界面,飞书CLI为AI Agent专门设计的Skills系统才是最具创新价值的部分。

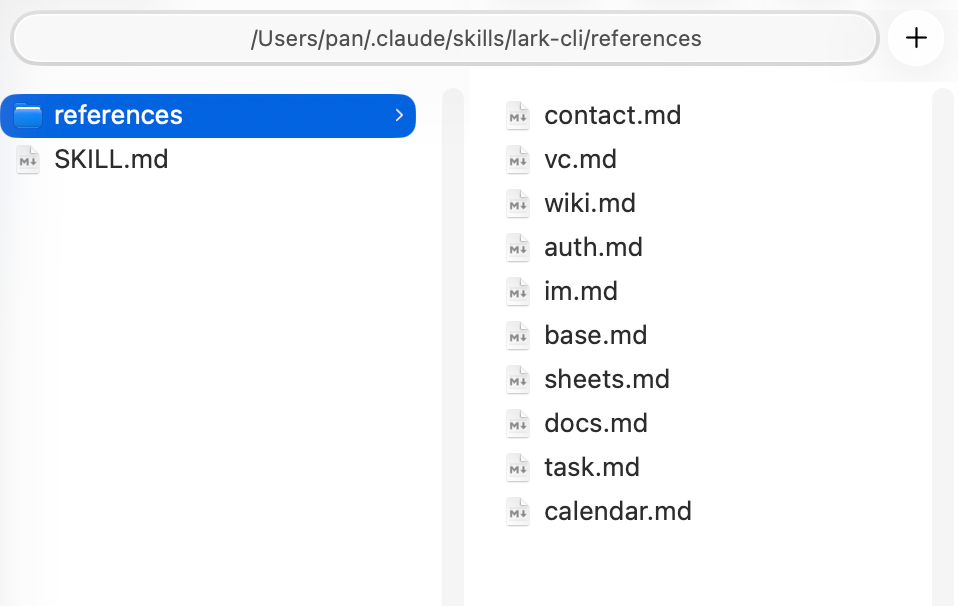

通过npx skills add larksuite/cli -y命令,可以一键安装19个结构化Skills文件,覆盖日历、消息、文档、表格、邮件、任务等业务域。

每个Skill文件本质上是一份结构化指令文档,包含:

- 可用命令清单

- 调用语法规范

- 参数定义与约束

- 权限要求说明

这意味着你可以直接用自然语言指示AI助手:"帮我整理今天的会议纪要,生成飞书文档,并发送到项目群"。

AI Agent通过理解Skills文档,自动分解任务、调用相应命令、处理返回结果,无需人工中间介入。

为什么命令行是AI的最优介质?

- 结构化输入:明确的参数定义,无GUI的模糊性

- 确定性输出:JSON或表格格式,便于解析和后续处理

- 易于链式调用:多个命令可组合成复杂工作流

- 低计算成本:相比API网络往返,本地命令执行更快

快速上手指南

从零到可用,只需三个步骤:

# 步骤1:全局安装CLI

npm install -g @larksuite/cli

# 步骤2:初始化配置与登录

lark-cli config init

lark-cli auth login --recommend

# 步骤3:验证可用性

lark-cli calendar +agenda

完成上述操作后,你就可以将飞书客户端从日常工作流中移除,所有操作在终端中完成。

实践中的调优建议

在深度使用过程中,我发现命令行参数众多、规范调用存在一定学习成本。

为此,建议建立本地Skill参考库,包含:

- 常用命令模板与参数说明

- 错误代码索引与解决方案

- 工作流自动化脚本示例

这样可显著降低调用报错率,提升实际执行效率。

个人总结

作为一个持续观察AI工具链的从业者,我认为飞书CLI的推出代表了一个重要转向:企业应用开始为AI能力提供原生支持,而不是被动适配。

Skills系统的引入更是关键——它让AI不再是"调用API的黑盒",而是能够理解业务规范、执行结构化指令的合作者。

这种设计思路的推广意义在于:当更多企业应用都提供类似的CLI+Skills组合时,AI自动化的天花板会大幅提升。

从简单的消息转发,到复杂的跨系统工作流编排,都将变得可行且高效。如果你还在用鼠标点客户端,是时候考虑升级到命令行驱动的工作方式了。