去年做公众号时,我写过一篇百万阅读的文章,单篇收益6000多元。

但后来我一直在想:这是内容本身的价值,还是账号自带权重?

为了验证这个逻辑,我单独开了新号用纯数据和工业化方法重做一遍。

当时用Cursor调用Claude处理全流程——抓28篇爆款、让模型分析内容类型、拉出100个选题、按框架逐一生成。

甚至连标点符号都没改就发了。

结果很极端:第四篇直接触发算法进池爆流量。后来我用同样方式做了4、5个号,都成功了。

但我停掉了。

原因很简单:这种纯流量驱逐没有复利,也没有个人资产沉淀。

只是机械地消耗热点。

不过那套工业化生产的底层逻辑非常能打。

最近我发现,如果把这套逻辑平移到智能体架构上,用OpenClaw配合Obsidian来做,效果不仅提升十倍,还能真正建立长期的数据壁垒。

今天分享全套可复用的实操流程。

为什么是OpenClaw+Obsidian?

很多人每天用各种大模型,效率却没有质变。

根本原因是使用方式碎片化:想到一个点子,去问AI,得到文章,复制发布,关闭网页。

下次再来,重新设定背景、重新调教语气。

每次都在重复无效劳动。

真正的系统化创作应该是这样:

你有一个想法,记录进选题库 → AI自动检索积累的爆款素材库 → 匹配已验证的内容结构进行写作 → 文章数据反馈沉淀到方法论里

这个闭环需要两个核心组件:

1. 本地化的知识底层数据库

Obsidian就是这个角色。它是完全本地的Markdown知识管理工具,核心优势是双向链接——能把孤立的文本片段连接成立体的知识网络。不依赖云服务,所有数据结构化存储在本地。

2. 后台自动执行的驱动引擎

OpenClaw是可以7×24小时在后台运行的守护进程。它不需要打开对话框聊天,你只需通过手机接口发指令,它就在后台自动读取Obsidian文件、执行检索、拼接和写作。

这个组合对个人IP创作者、公众号作者,或需要大规模铺设SEO博客、运营海外社媒的跨境电商企业来说,都是一套极具统治力的基础设施。

效果演示:内容生产流程被彻底重构

有了这套系统以后,工作流是这样的:

上午看到好素材

走在路上,看到优质行业报道,随手复制链接发给手机Agent。OpenClaw在云端静默抓取正文、提取逻辑、打上元数据标签,自动同步到本地Obsidian灵感库。

晚上处理灵感

坐在电脑前,一句指令启动处理。Agent自动调取素材生成选题角度,甚至可以网上实时搜索。给出的选题都是经过市场验证的。

生成大纲和初稿

让它生成大纲、写文章。如果需要调整,直接改md文件,Agent读取记忆库后续自动适配。

接下来,直接看具体配置步骤。

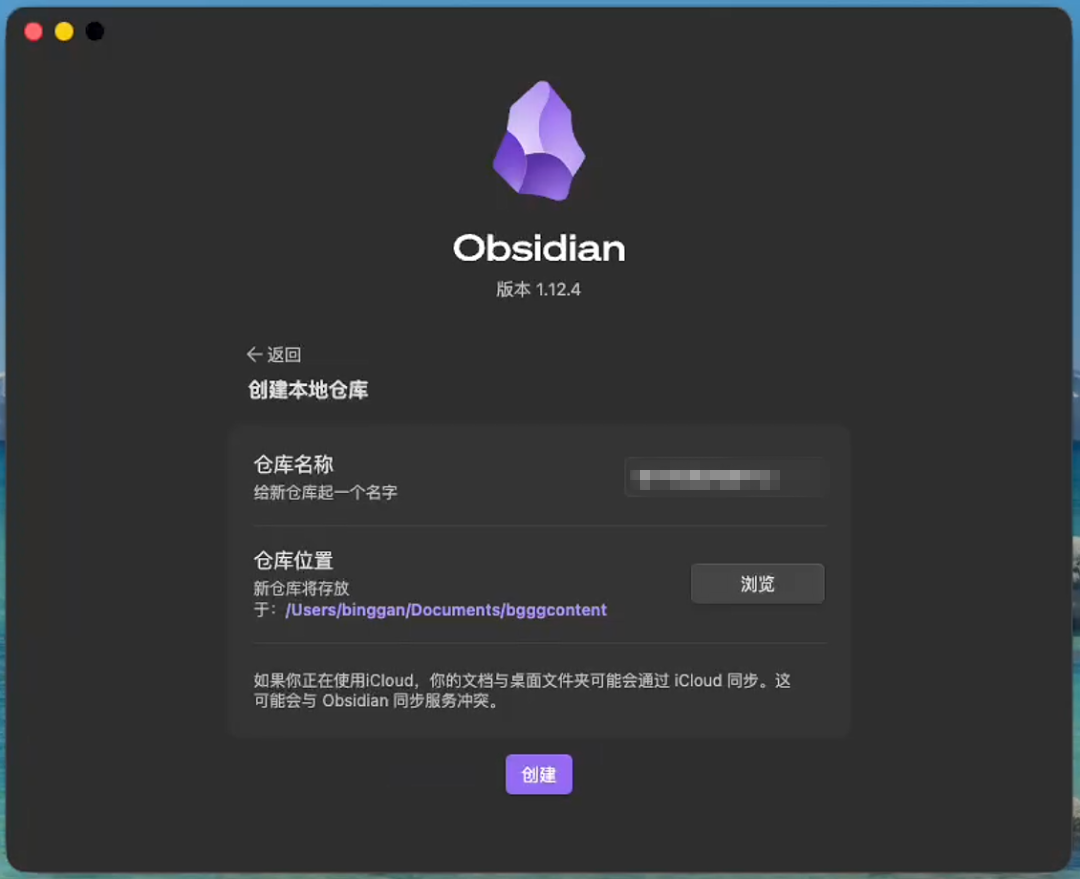

第一步:安装Obsidian并初始化仓库

在官网下载Obsidian

本地新建一个空文件夹作为仓库(Vault),命名为 bgggcontent (这里用你自己的项目名)。

关键提示:不要让OpenClaw直接操作这个文件夹。

原因是大模型在操作系统层面执行命令很直接。如果直接赋予文件读写权限,当AI判断某篇笔记需要重新归类时,会直接调用Linux的mv指令。这在普通文件夹没影响,但在Obsidian里会导致严重错误——源文件被强行重命名或移动后,所有指向该文件的内部链接全部失效,整个知识系统出现大量死链。

解决方案:使用obsidian-cli工具

安装命令行工具:

npm install -g obsidian-cli在OpenClaw中严格挂载官方的obsidian-skills。

这确保了AI在移动或删除笔记时,都会向Obsidian底层引擎发送信号,全局引用关系自动更新。

第二步:通过软链接打通多Agent矩阵

内容中台的终极形态不是单一智能体包揽所有工作,而应该有多个专职Agent:

- 研究员Agent:全网监控抓取素材

- 撰稿Agent:撰写小红书、公众号文案

- 审稿Agent:统筹全局质量把控

但OpenClaw的沙盒机制很严格,每个Agent只能访问自己工作区的文件。如果把库建在单个工作区,其他Agent就丧失访问权限。

最佳方案是使用操作系统软链接(Symlink)进行跨界映射。

第一步,将真实库文件夹建立在安全的个人文档路径下:

/Users/binggan/Documents/bgggcontent第二步,打开终端,为各Agent建立直达中央数据库的通道:

ln -s /Users/binggan/Documents/bgggcontent /Users/binggan/.openclaw/workspace-lead/bgggcontent

ln -s /Users/binggan/Documents/bgggcontent /Users/binggan/.openclaw/workspace-xhs/bgggcontent

ln -s /Users/binggan/Documents/bgggcontent /Users/binggan/.openclaw/workspace-gzh/bgggcontent这样,每个Agent工作区里都有一个bgggcontent软链接,都能直接操作同一个中央数据库。

效果是:素材库成为唯一真实数据源。研究员刚把竞品分析丢进爆款素材库,公众号撰稿Agent就能在零延迟下瞬间读取并投入写作。

第三步:建立核心目录映射和流转规则

完成底层通道打通后,需要在Obsidian内部确立流转目录。不需要繁琐的嵌套结构,只需遵循内容生产生命周期:

| 目录 | 功能说明 |

|---|---|

| 01-灵感与素材库 | 分为日常灵感剪报和爆款素材片段。平时刷到的长文存前者,金句和逻辑框架提炼后存后者 |

| 02-选题池 | 经过人工确认或AI衍生的待写命题 |

| 03-内容工厂 | 细分为大纲挑选区、初稿打磨区、终稿确认区。AI高频读写的核心车间 |

| 04-已发布归档 | 所有公网发布的成品最终沉淀于此 |

强制元数据管理

让OpenClaw在海量Markdown文件中精准定位处理环节,必须强制推行元数据管理。系统内严禁出现纯文本裸文件。每篇文档顶部必须携带标准的YAML属性表头:

---

title: 文章标题

阶段: 灵感 / 选题 / 大纲 / 初稿 / 终稿 / 已发布

关联参考: [[灵感库文件]]

发布平台: 公众号

---这是AI识别文件状态的唯一索引。缺乏属性区,大模型会在图谱中彻底迷失方向。

第四步:配置Agent执行准则

物理环境就绪后,需要配置OpenClaw Agent的核心规则文件。进入公众号Agent的工作区(workspace-gzh),建立四个底层规则文件。

文件1:SOUL.md — 系统底线声明

这是安全防线的底线。设定AI的行事边界:

## SOUL.md - 系统底层运行法则

### 1. 绝对的操作护栏

- 严禁使用Linux原生的mv或rm命令操作bgggcontent目录下的任何文件

- 所有涉及文件的移动、重命名、删除,必须且只能调用obsidian-cli

- 必须严格遵循obsidian-skills规范生成Markdown文本

### 2. 强制元数据注入

- 在bgggcontent目录下创建的任何.md文件,文件最顶部必须包含标准YAML属性

- 禁止生成纯文本的无属性文件

### 3. 目录越权禁止

- 活动范围仅限于当前工作区和软链接的bgggcontent

- 严禁访问系统其他目录或修改.git、.obsidian等隐藏文件夹文件2:USER.md — 创作风格设定

明确指出你拒绝的AI常见词汇,强制要求特定的写作风格:

## USER.md - 创作者偏好与风格设定

### 1. 平台调性

微信公众号。文章需要深度,适合碎片化阅读,但逻辑严密。

### 2. 语言风格

- 拒绝常规AI词汇:总而言之、不可否认、在这个瞬息万变的时代

- 喜欢短句,多用换行留白

- 语气要求:真诚、专业、带一点极客的分享欲

### 3. 排版习惯

- 用>引用框突出金句

- 列表项清晰,多用**加粗**强调核心关键词

- 段落间空行分隔,便于阅读文件3:AGENTS.md — 启动必读清单

控制AI每次启动时必须读取的内容:

## AGENTS.md - 每次启动必读清单

### Every Session - Before doing anything else:

- Read SOUL.md — 这是你的行事底线

- Read USER.md — 这是用户的偏好

- Read memory/YYYY-MM-DD.md (today + yesterday) — 近期上下文

- If in MAIN SESSION: Also read MEMORY.md — 历史记忆库

- Read SOP_GZH.md — 你的核心内容生产工作流,灵活执行文件4:SOP_GZH.md — 标准作业程序

将业务逻辑固化为精确的触发条件与对应动作。这样日常就不需要每次都重新输入指令:

## SOP_GZH.md - 内容生产标准作业程序

### 阶段1:灵感捕获

**触发条件**:用户发送微信/小红书链接或原文

**执行动作**:

- 将原文整理存入「01-灵感与素材库/1-日常灵感剪报/」

- 从中提炼1-3个选题,新建文件存入「02-选题池/待写选题库/」

- YAML的「关联参考」链接对应灵感原文

### 阶段2:素材沉淀

**触发条件**:用户发送金句或特定逻辑框架

**执行动作**:

- 打上相应标签,存入「01-灵感与素材库/2-爆款素材片段/」

- 提取核心逻辑,便于后续大纲写作调用

### 阶段3:选题立项与大纲生成

**触发条件**:用户问「今天写什么」或指定某个选题

**执行动作**:

- 先列出「待写选题库」中的全部选题供用户选择

- 选定后,必须先检索灵感库,结合参考资料生成3个不同切入点的大纲

- 将大纲存入「03-内容工厂/1-大纲挑选区/」等待用户确认

- **严禁不经检索直接生成大纲**

### 阶段4:初稿打磨

**触发条件**:用户确认某一大纲

**执行动作**:

- 读取USER.md中的写作风格

- 主动检索「2-爆款素材片段」寻找合适金句润色

- 按公众号格式生成初稿,存入「03-内容工厂/2-初稿打磨区/」

### 阶段5-7:终稿确认与归档

**触发条件**:用户发回修改后的文本,标注这是终稿且已发布

**执行动作**:

- 使用obsidian-cli move将文件从初稿区移动至「04-已发布归档/公众号已发布/」

- 更新YAML状态为「已发布」

- 日期和阅读数据沉淀为下次决策参考第五步:一键初始化

以上所有文件配置好后,让OpenClaw在本地硬盘上真正建立这些文件夹和规则文件。可以用以下初始化指令(通过对话框或Agent接口发送):

@init-content-factory

请按照以下结构初始化整个内容工厂系统:

## 物理结构

- 在bgggcontent下创建全部四级目录

- 在workspace-gzh下创建SOUL.md、USER.md、AGENTS.md、SOP_GZH.md四个文件

- 内容按前面的代码块严格复制

## 验证清单

- 确认所有目录都创建成功

- 确认所有规则文件都包含完整内容

- 尝试调用obsidian-cli测试是否连接正常

- 列出初始化后的完整目录树供我确认总结:从机械流量到可复用资产

做内容最初的诱惑是流量,一篇爆文能带来几千块收入。

但那套方法本质上是在消耗热点,没有任何复利。

这套OpenClaw+Obsidian的系统不同。

它的价值在于:

1. 素材库变成数据资产

每一条抓取的爆款、每一个被验证的选题角度都会持久存储。一年下来,你拥有的不是消散的流量,而是可以无限复用的内容算法。

2. 流程变成可扩展系统

今天可能只有你一个公众号Agent,明天可以轻松扩展到小红书、视频号、海外独立站。因为底层架构是通用的,新增Agent只需链接同一个数据库。

3. 决策变成数据驱动

每篇发布的内容都会记录YAML元数据——发布时间、阅读量、互动数据。这些数据反馈到选题库和素材库里,让下一次的写作决策更精准。

从我的经验看,个人创作者最大的资产不是粉丝数,而是已被市场验证的、可复用的内容模板和决策模型。这套系统让这些无形资产真正可见化、结构化、可复用化。

需要特别说明的是,这套流程的核心不在AI有多聪明,而在于你对自己工作边界、数据流向的清晰定义。

约束越明确,AI的执行效率越高。反过来说,如果你现在还在用大模型做「一问一答」式的工作,那你其实还没有进入系统化创作的阶段。

希望这套实操流程对你有参考价值。