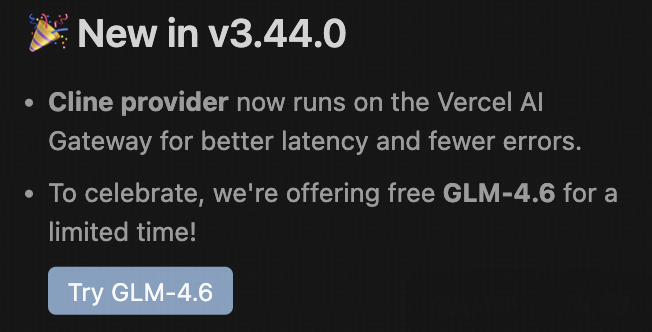

这两天在更新 Cline 到 v3.44.0 时,看到官方把 GLM‑4.6 直接开放到 cline:z-ai 端口,且限时免费。

我作为长期在 IDE 里对比不同代码助手的产品经理,第一反应不是“羊毛”,而是:这次是否值得把它纳入团队的评估清单,替换或并行于现有的 Claude Code、Sonnet 4 等方案?

Cline更新

模型开放:GLM‑4.6 限时在 Cline(v3.44.0)免费使用,入口为 cline:z-ai。

上下文能力:官方将上下文窗口从 128K 扩到 200K,适合整包文档/代码库协同分析。

性能指标:在 SWE‑Bench Verified(74 项真实环境编码测试)上,官方称 GLM‑4.6 追平或超过 Claude Sonnet 4。

效率优化:相比上一代,官方称 Token 消耗下降 30%+,同任务响应更快。

前端生成:在视觉与结构层面,官方强调前端页面生成质量提升(审美与布局更稳定)。

底层链路:Cline 接入 Vercel AI Gateway(全球百余加速节点),官方数据为整体延迟降低约 20%、错误率下降约 24%,对速度敏感模型(如 Grok、Minimax)响应提升约 40%。

费用与定价:该链路当前标注为零溢价,Cline 未加价转售;此前 GLM 套餐有 20 元/月选项,此次免费更适合评估。

上手体验(VS Code + Cline)

两个常规任务,尽量贴近团队日常开发:

- 任务 A:导入一个含遗留 TypeScript 代码和技术文档的中型项目(约数万行),要求“先理解,再小步重构”。

- 任务 B:给定设计简要与组件库约束,生成一个营销落地页的首版,并调整可访问性与响应式。

观察点与感受(结合官方数据与主观体验):

- 长上下文:把文档和关键模块一次性送入后,模型能在后续对话中稳定引用与定位,减少“重复解释”的成本。大段上下文下仍建议明确约束(入口文件、目录结构、测试目标),可以减少偏题。

- 重构策略:多文件修改时,模型建议的改动粒度较合理(分阶段、先接口后实现),对于跨模块依赖能给出可验的调整清单。实际落地仍需配套测试用例与 CI,避免一次性大改。

- 前端生成:页面初版的视觉与语义标签使用比上一代更稳(例如更一致的栅格与可访问性属性),但复杂动效与设计还原度仍取决于你的约束描述与组件库规范。

- 响应速度:在我的网络环境下,短回答通常为 2–4 秒;多文件编辑与长上下文任务为 20–60 秒不等。主观上比上周版本稳定,失败重试次数更少。不同地区与网络条件会影响体感。

- Token 开销:未做严格量化,但长会话下,提示更简洁、减少重复背景叙述,能明显降低不必要的上下文回传。与团队落地时建议接入日志,实际测 Token 与时延。

差异化与适配性

| 维度 | GLM‑4.6 @ Cline(z-ai) | Claude Code / Sonnet 4(官方订阅) | 上一代 GLM(参考) |

|---|---|---|---|

| 获取方式 / 成本 | 限时免费;Cline v3.44.0 即用 | 付费订阅;按官方套餐 | 曾有 20 元/月套餐 |

| 上下文窗口 | 200K(官方) | 大窗口(依版本与套餐,官方为准) | 128K(官方) |

| 编码基准表现 | SWE‑Bench Verified ≈/> Sonnet 4(官方) | 在多项榜单上表现稳定(官方) | 低于 4.6(官方) |

| 延迟与稳定性 | Vercel Gateway:延迟 −20%,错误率 −24%(官方) | 取决于地区与官方 API 配置 | 相对更高延迟与错误率 |

| Token 效率 | 较上一代 −30%+(官方) | 取决于模型与提示设计 | 较高 |

| 前端生成质量 | 官方称审美与结构提升;我的体验更稳 | 成熟度高,但依任务而异 | 较弱 |

| 集成与门槛 | Cline 内置,更新即用 | 需账号与订阅,IDE 插件因生态而异 | 同供应商方案 |

| 适合人群 | 需要评估或临时扩容代码助手的团队与个人 | 已有稳定付费链路与合规需求的团队 | 预算敏感、可接受性能折中的用户 |

适合的使用场景

- 跨文件重构与文档驱动开发:大上下文 +分阶段建议,对理解遗留代码有效。

- 前端页面首版与迭代:组件化约束明确时,能快速产出可用版本并迭代语义与响应式。

- 增量改造与测试补全:在给出既有测试框架与边界条件后,补全用例与修复常见错误。

不完全适配或需额外验证的场景

- 对安全与合规要求严格的企业环境:需评估通过 Vercel Gateway 的数据路径、日志与存储策略。

- 极端长时任务或超大仓库:虽然 200K 窗口提高上限,但仍应分批次与设定边界,避免提示漂移。

- 强约束的工程流程(例如必须遵循内部代码规范/变更流程):需要结合提示模板与 Cline 的工作流配置,减少自由发挥。

如何在 Cline 中启用

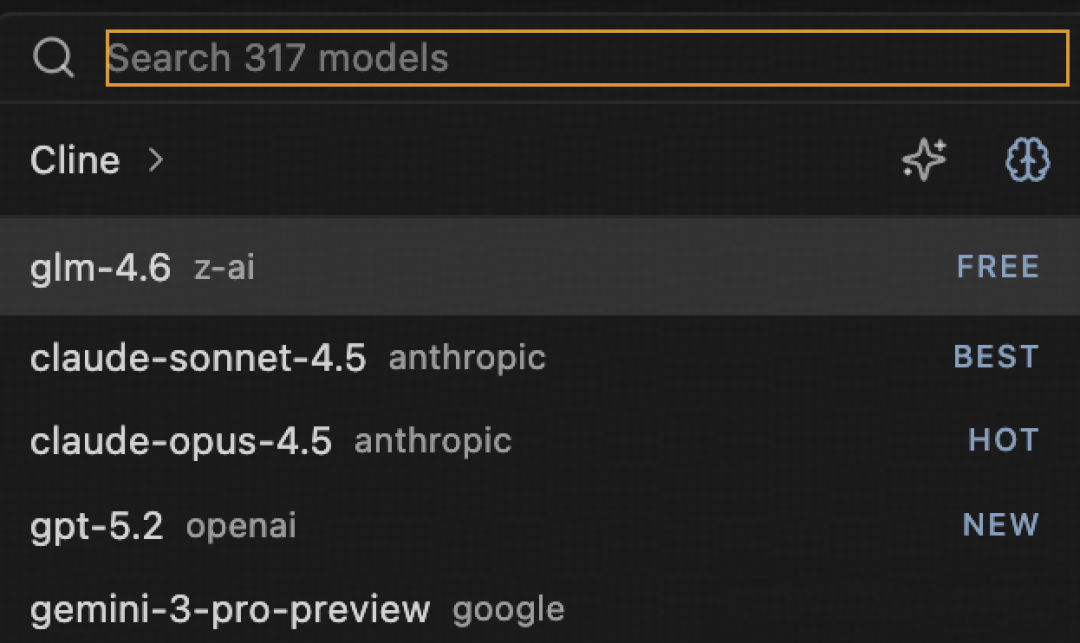

更新 Cline 至 v3.44.0。

在提供商选择中切换到 cline:z-ai,选择模型 GLM‑4.6。

准备一个小型评估项目:包含技术文档、核心模块与测试框架,限制一次改动范围。

记录数据:响应时延、Token 使用量、提交的 diff 大小与编译/测试结果,通过日志或脚本收集。

与现有助手并行对比:相同任务、相同提示模板,确保结论可复用与可推广。