我在近期收集整理了多款Claw工具,重点考察其在本地环境下的部署便捷性、与国内主流大模型及办公平台的适配程度。

j昨天的分享中有粉丝提到新手该选择哪款Claw,我的建议还是先上手OpenClaw。

不过对于新手OpenClaw的英文版不够友好,最近看到了国内社区推出的OpenClaw中文版,我觉得该方案更适合小白用户快速在本地搭建OpenClaw并上手体验,并结合阿里云百炼的Coding Plan更低成本的上手并使用。

详细部署操作流程

步骤 1:执行一键安装脚本

OpenClaw中文版(openclaw中文社区)提供了针对 Windows 环境的自动化安装脚本,该脚本会自动检测并安装所需的 Node.js 运行时及核心依赖。

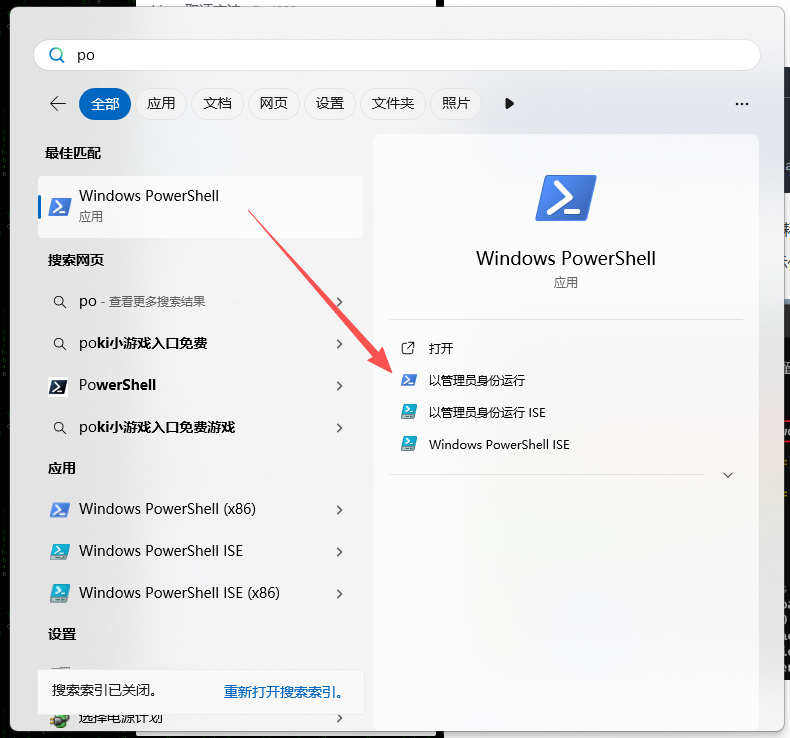

以管理员身份打开 PowerShell。

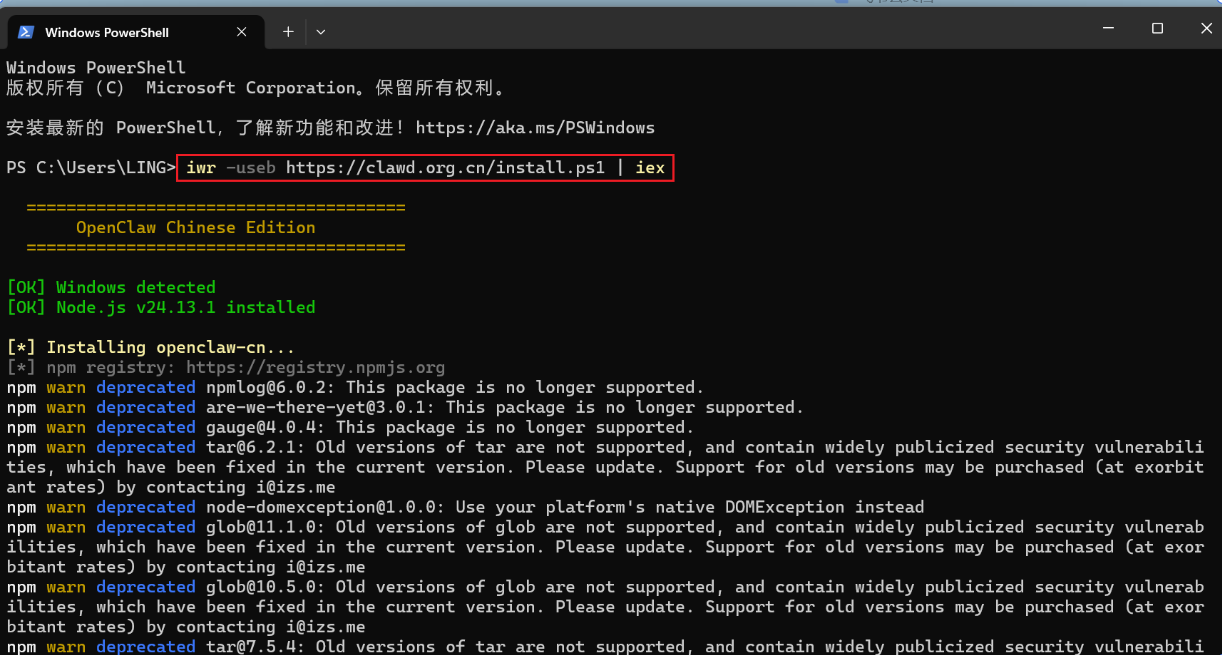

复制并执行以下命令:

iwr -useb https://clawd.org.cn/install.ps1 | iex

-

执行反馈:脚本运行后,终端将显示下载进度。整个过程耗时约 2-5 分钟,取决于网络状况。

-

状态确认:安装完成后,系统会自动进入配置向导提示,或显示安装成功的具体路径信息。

步骤 2:获取阿里云百炼 API Key

为什么推荐 OpenClaw 阿里云百炼:

-

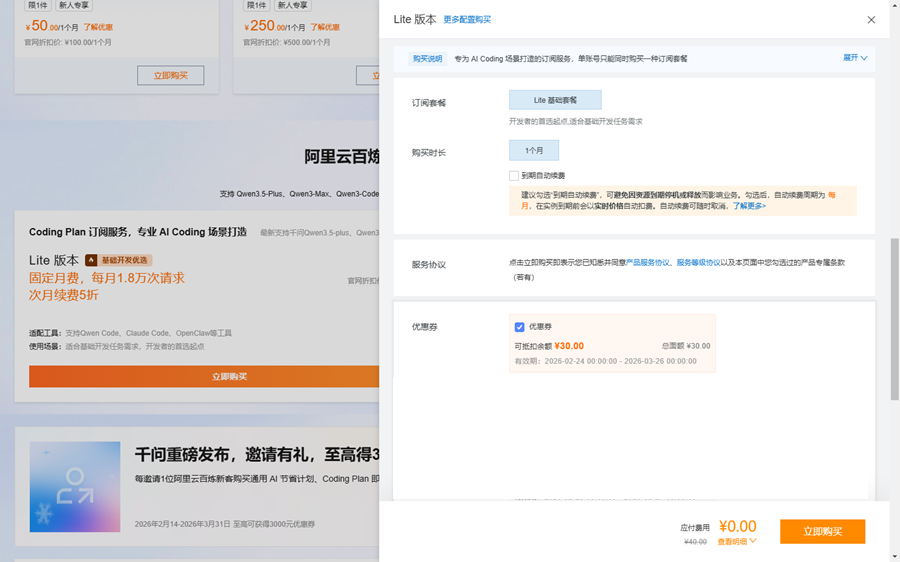

入门套餐门槛低,适合刚上手的用户,新用户获得优惠券抵扣,可以0元入手!

-

按次消耗,不用担心Token消耗带来的不确定费用

-

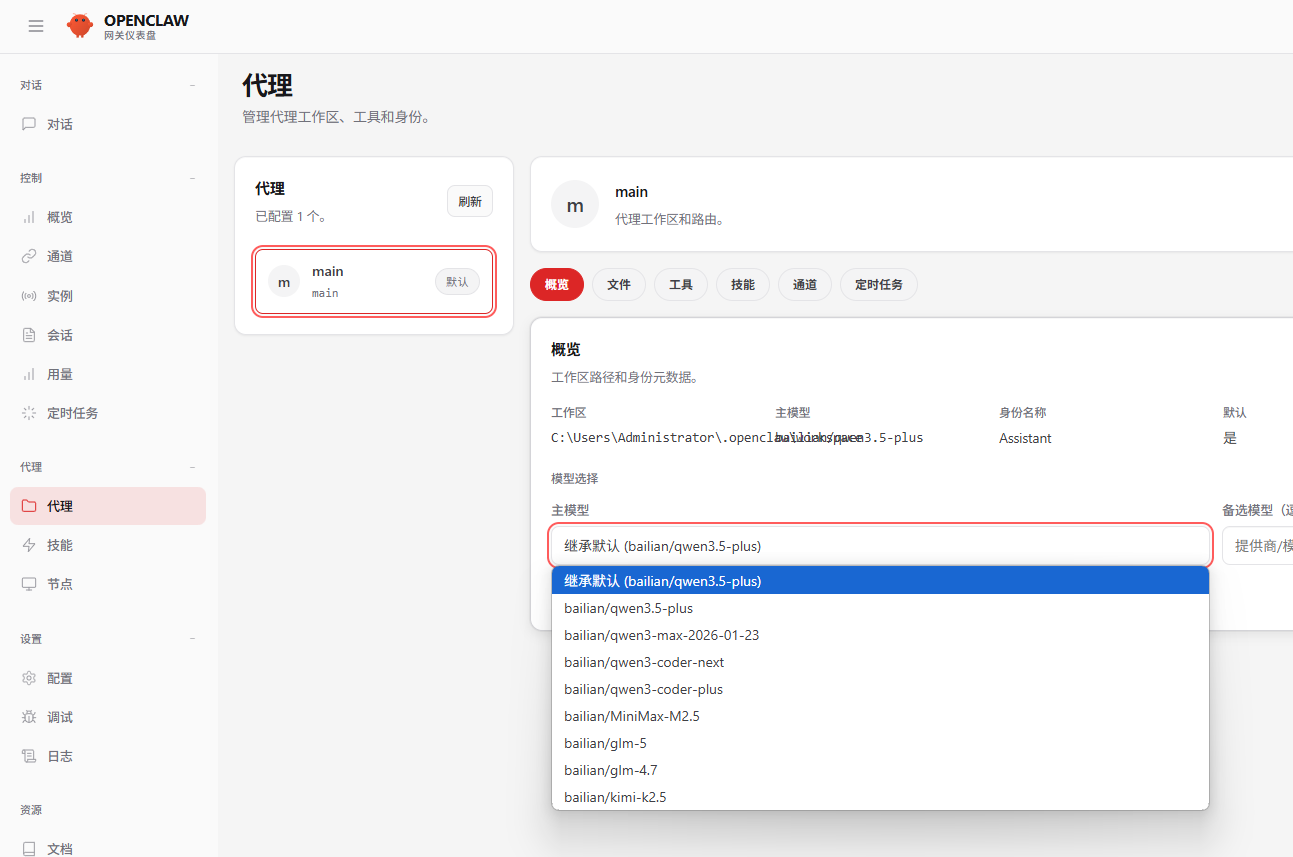

支持Qwen3.5、Qwen3-max、Qwen3-coder、GLM-5、GLM-4.7、Kimi-k2.5等模型

访问阿里云OpenClaw专属优惠券链接:

https://www.aliyun.com/activity/ecs/clawdbot

选择要开通的套餐版本,刚上手用量不大推荐:Lite 版本

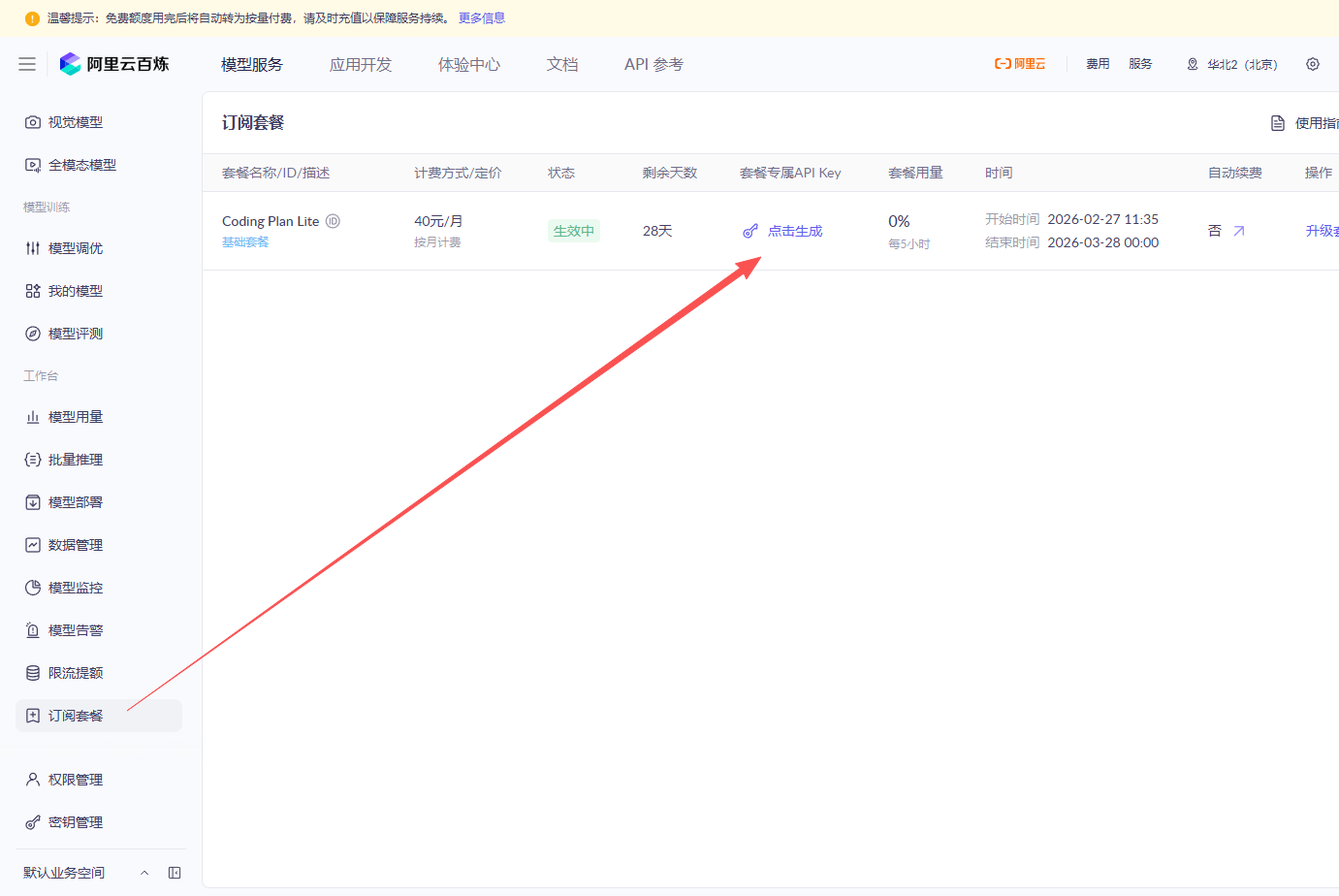

套餐开通成功后,在左侧导航栏找到 订阅套餐,点击生成 创建套餐专属 API Key。

安全提示:创建成功后,立即复制生成的 Key,并妥善保存。

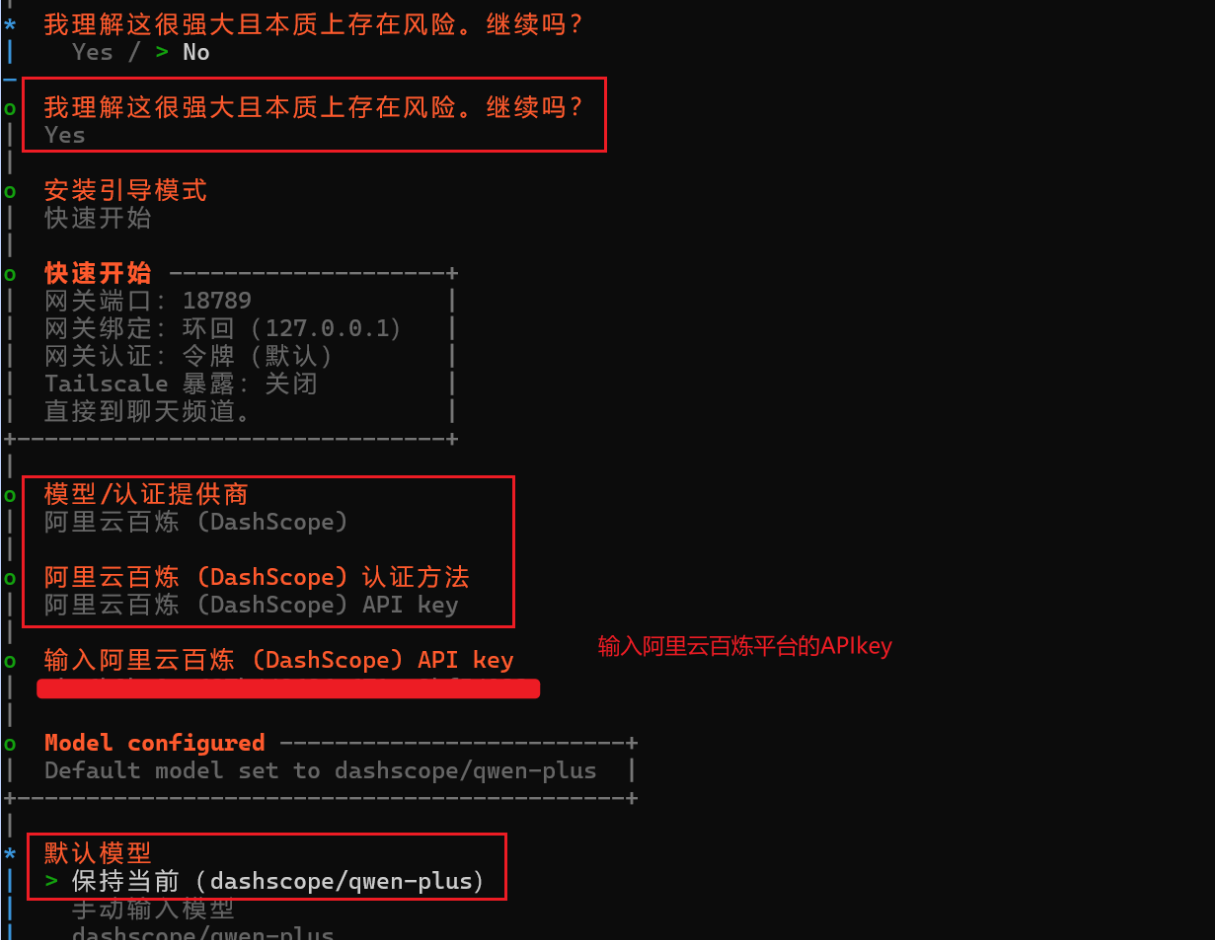

步骤 3:启动初始化配置向导 (Onboard)

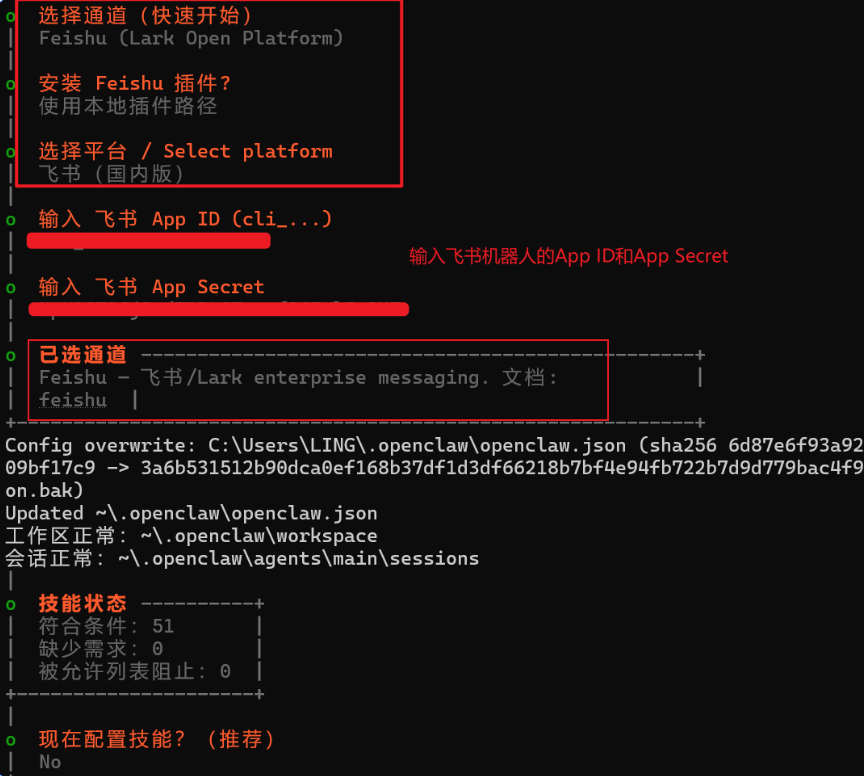

安装完成后,需通过命令行工具 openclaw-cn 进行首次初始化配置。

重新打开一个 CMD 或 PowerShell 窗口(确保环境变量已刷新)。

输入以下命令启动向导:

openclaw-cn onboard

确认继续:当提示是否继续配置时,选择 YES。

选择模型提供商:在模型列表中选择 阿里云百炼 (Aliyun Bailian)

输入 API Key:系统将提示输入 API Key,此处要先跳过(原因是我实测了跟openclaw阿里云百炼配置方式不同,后面我会教如何修改)

步骤 4:配置飞书机器人渠道 (关键步骤)

此步骤涉及飞书开放平台的应用创建与权限配置,是实现消息互通的核心。

4.1 创建企业自建应用

访问 并登录,点击右上角的「开发者后台」

进入 企业自建应用,点击 创建应用,选择 机器人 类型。

填写应用名称(如 "OpenClaw")和描述,完成创建。

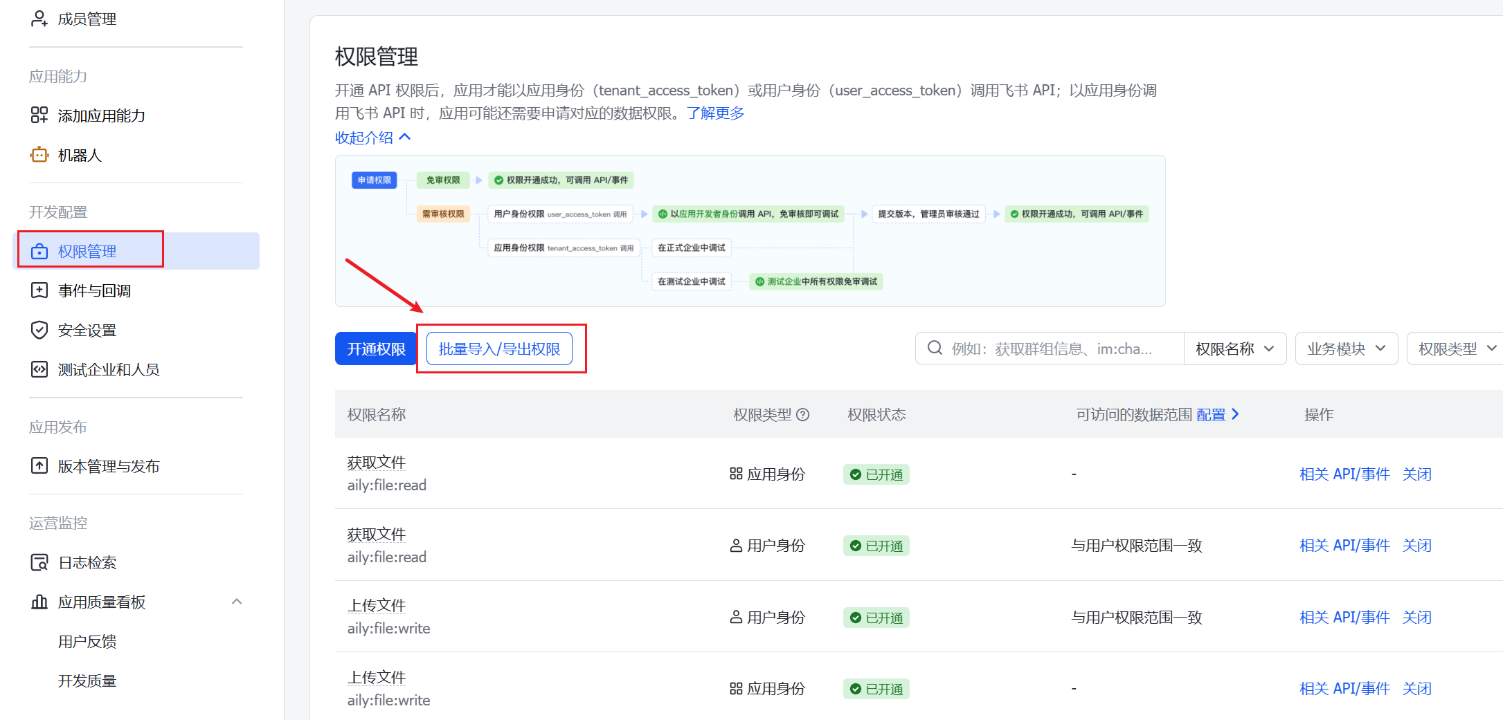

4.2 配置权限 scopes

这是最容易出错的环节,OpenClaw 需要特定的权限才能读取和发送消息。

在应用管理页面,进入 权限管理 -> 批量导入/导出权限。

清空现有权限:为避免冲突,建议先清空默认权限。

粘贴权限配置:将以下 JSON 内容完整复制到导入框中:

{

"scopes": {

"tenant": [

"aily:file:read",

"aily:file:write",

"application:application.app_message_stats.overview:readonly",

"application:application:self_manage",

"application:bot.menu:write",

"cardkit:card:write",

"contact:contact.base:readonly",

"contact:user.employee_id:readonly",

"corehr:file:download",

"docs:document.content:read",

"event:ip_list",

"im:chat",

"im:chat.access_event.bot_p2p_chat:read",

"im:chat.members:bot_access",

"im:message",

"im:message.group_at_msg:readonly",

"im:message.group_msg",

"im:message.p2p_msg:readonly",

"im:message:readonly",

"im:message:send_as_bot",

"im:resource",

"sheets:spreadsheet",

"wiki:wiki:readonly"

],

"user": [

"aily:file:read",

"aily:file:write",

"contact:contact.base:readonly",

"im:chat.access_event.bot_p2p_chat:read"

]

}

}

提交并保存权限配置。

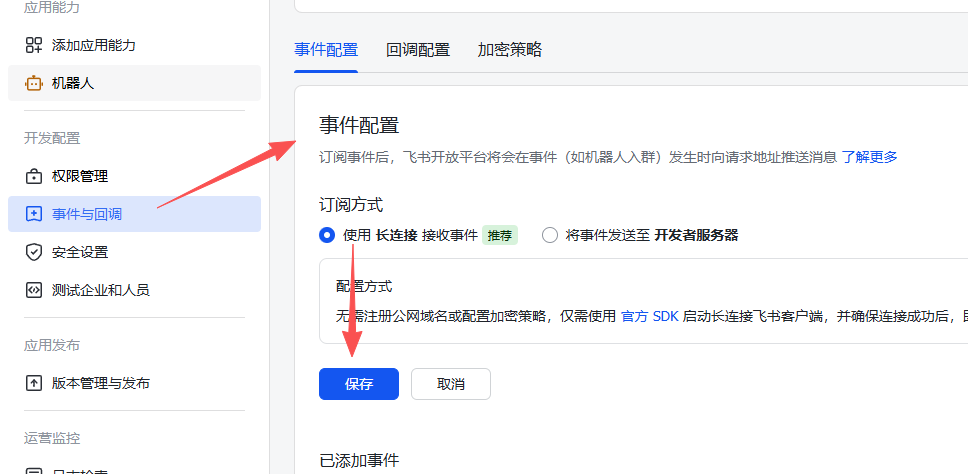

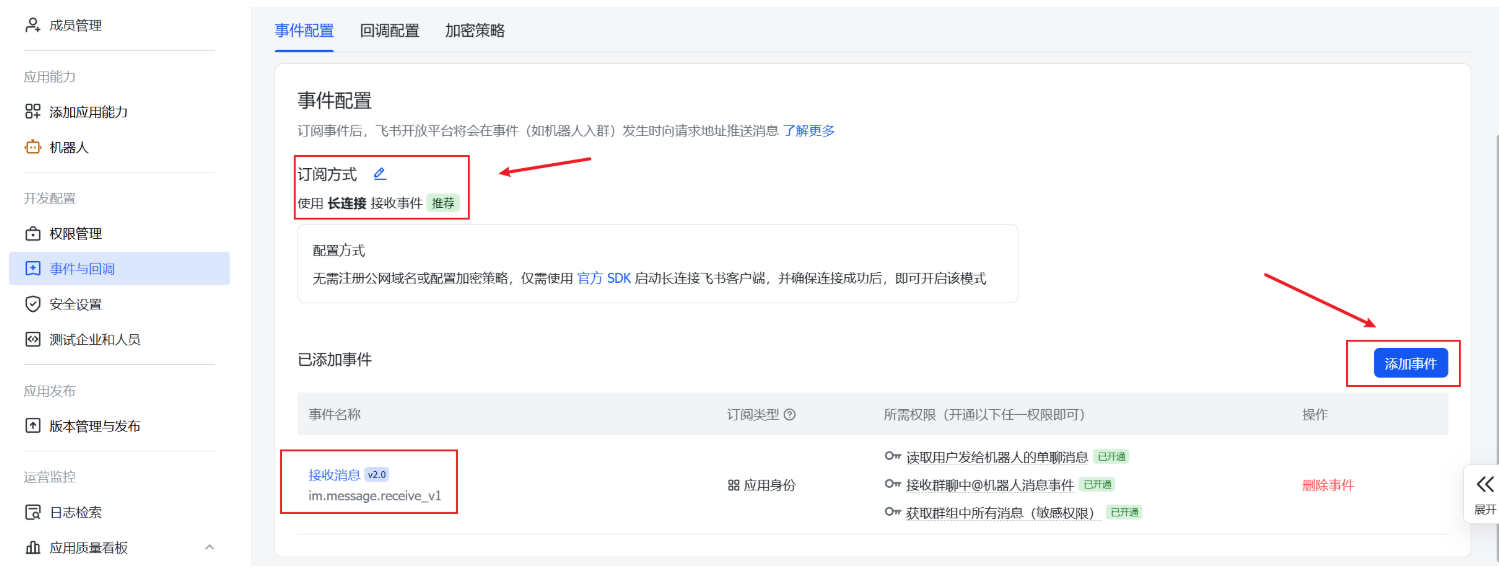

4.3 配置事件订阅 (长连接模式)

注意:根据最新实践,建议在 OpenClaw 网关启动前,先在飞书后台完成基础事件订阅配置,以避免向导过程中的超时或验证失败。

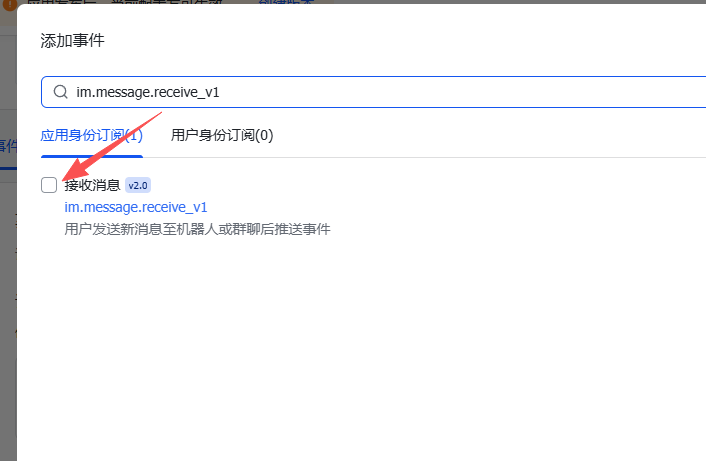

在应用管理页面,进入 事件与回调。

订阅方式:必须选择 长连接。点击保存

添加事件:需要订阅 im.message.receive_v1 (接收消息) 事件。

保存设置。

最后创建版本,并填写基本信息,发布版本

4.4 回填凭证至 OpenClaw

在飞书应用管理的 凭证与基础信息 页面,复制 App ID 和 App Secret。

依次输入 App ID 和 App Secret,完成渠道绑定。

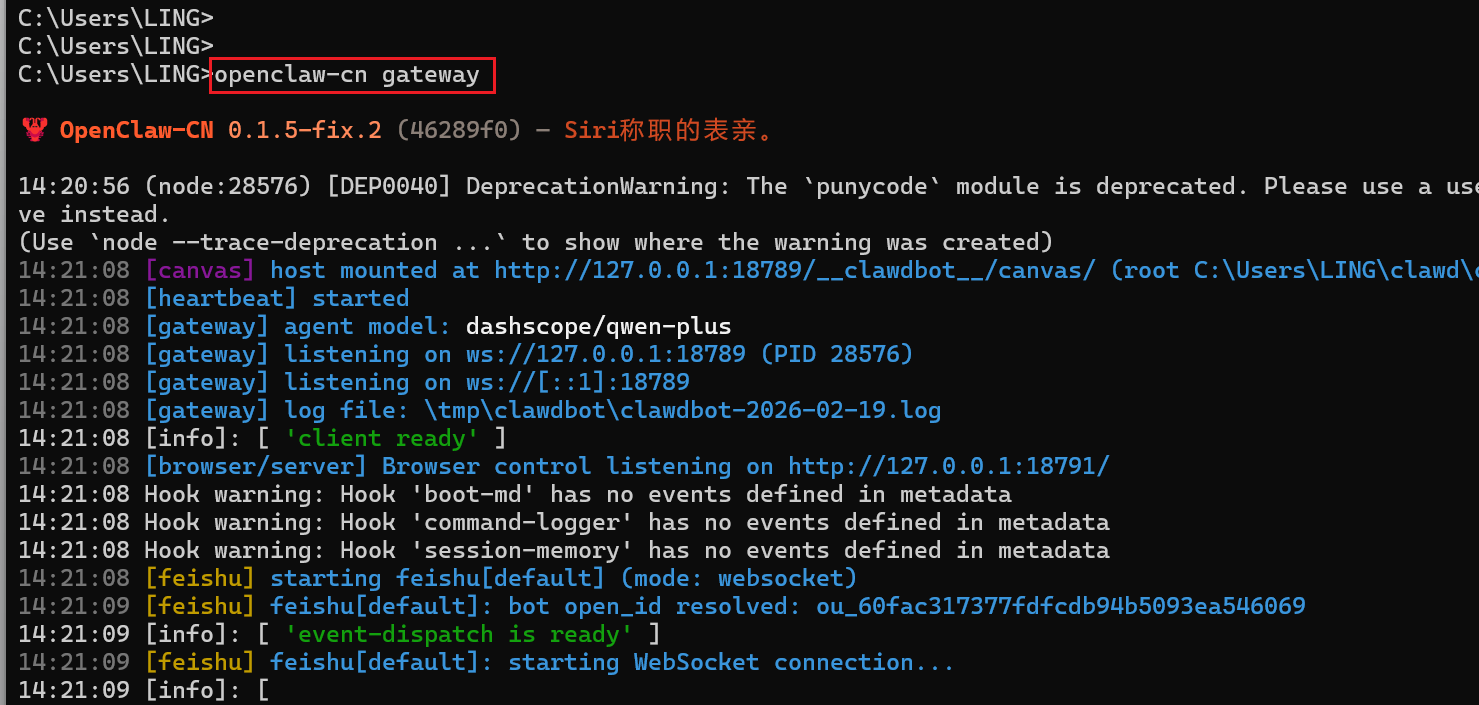

步骤 5:启动网关服务 (Gateway)

配置完成后,需要启动 OpenClaw 的网关服务。

该服务负责建立并维持与飞书服务器的 WebSocket 长连接,转发消息。

在终端执行:

openclaw-cn gateway

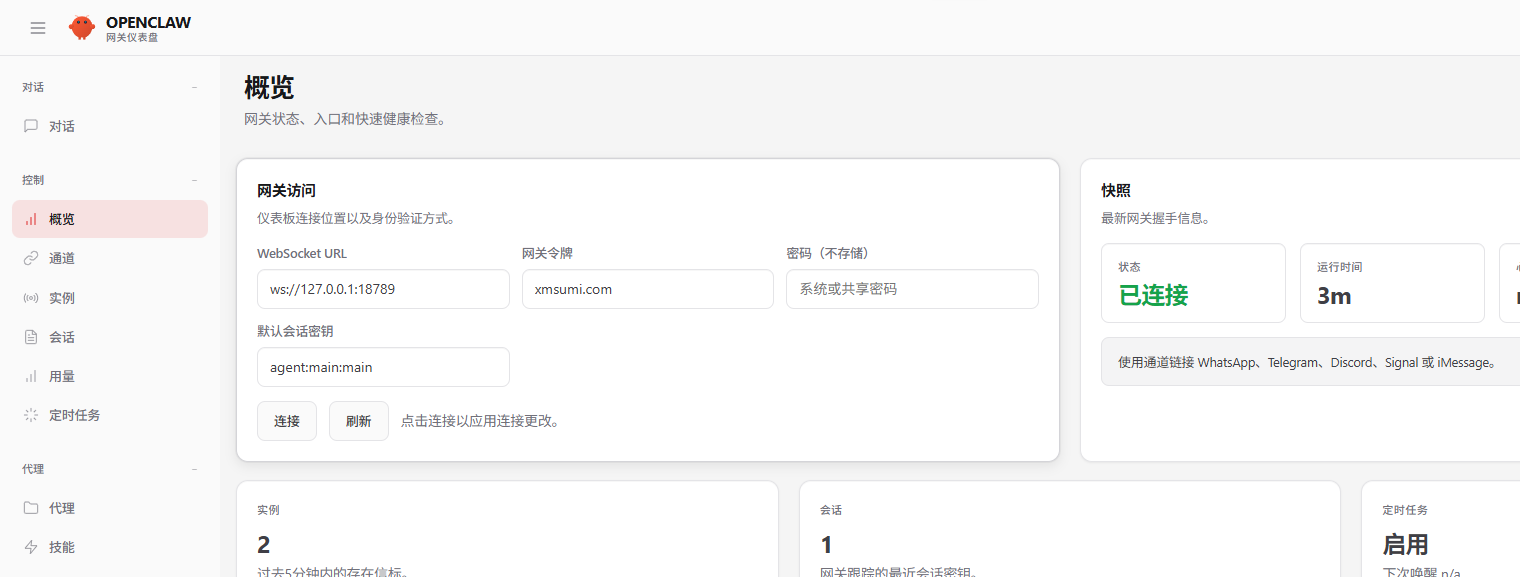

成功标志:看到类似 Listening on http://127.0.0.1:18789 或 Gateway ready 的日志输出。

运行要求:该窗口需保持运行状态。若需后台运行,可使用 nohup (Linux/Mac) 或 PM2 等进程管理工具;Windows 环境下可考虑使用任务计划程序或第三方工具保持会话活跃。

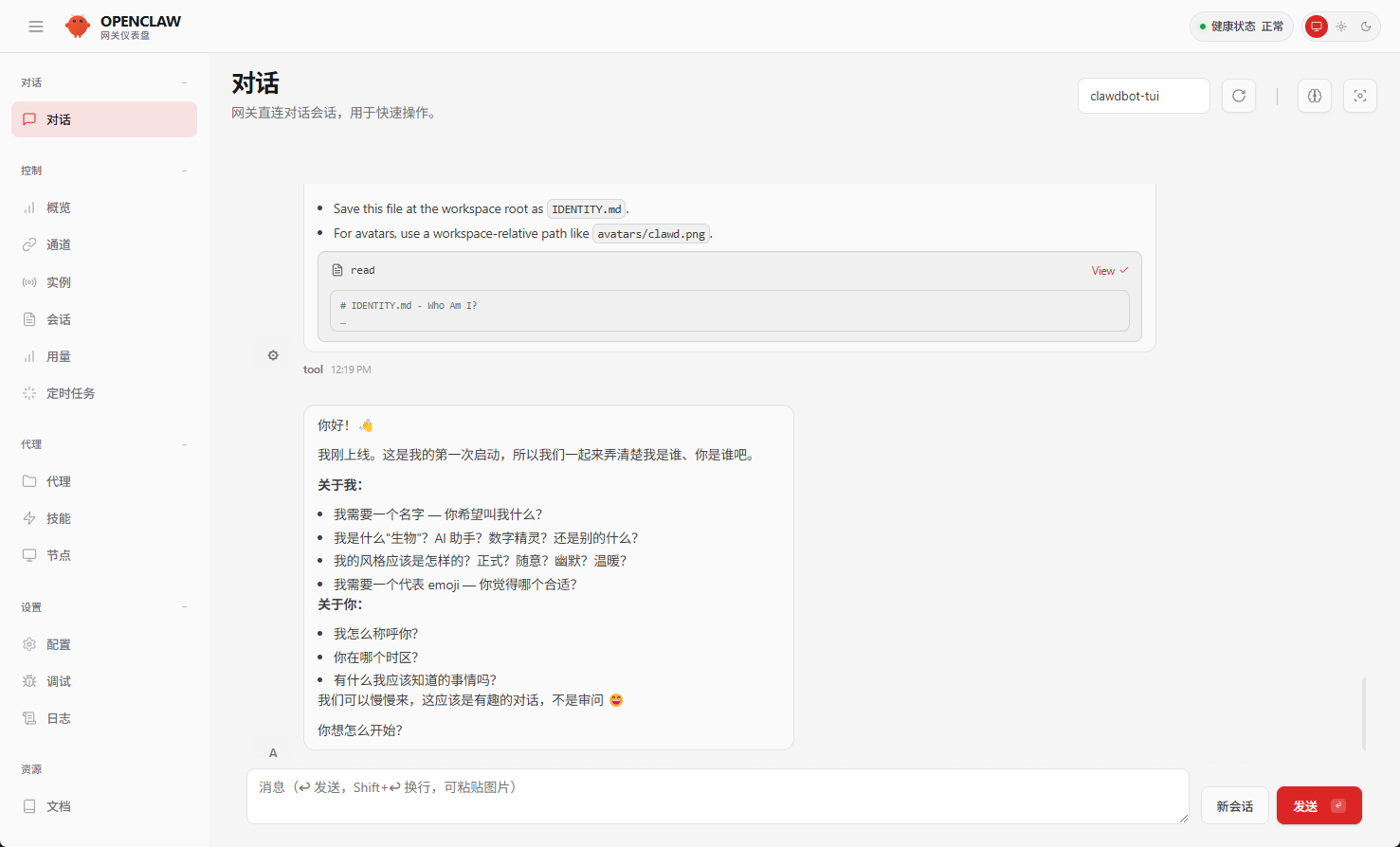

步骤 6:访问管理后台并验证连接

打开浏览器,访问网关启动时提示的地址: http://127.0.0.1:18789

登录 OpenClaw 管理后台,这个时候中文版的OpenClaw 就运行成功啦!

连接状态检查:

-

查看 渠道管理 或 系统状态 页面。

-

确认飞书渠道状态显示为 已连接。

-

核对事件订阅模式是否为 长连接。

步骤 7:功能性测试

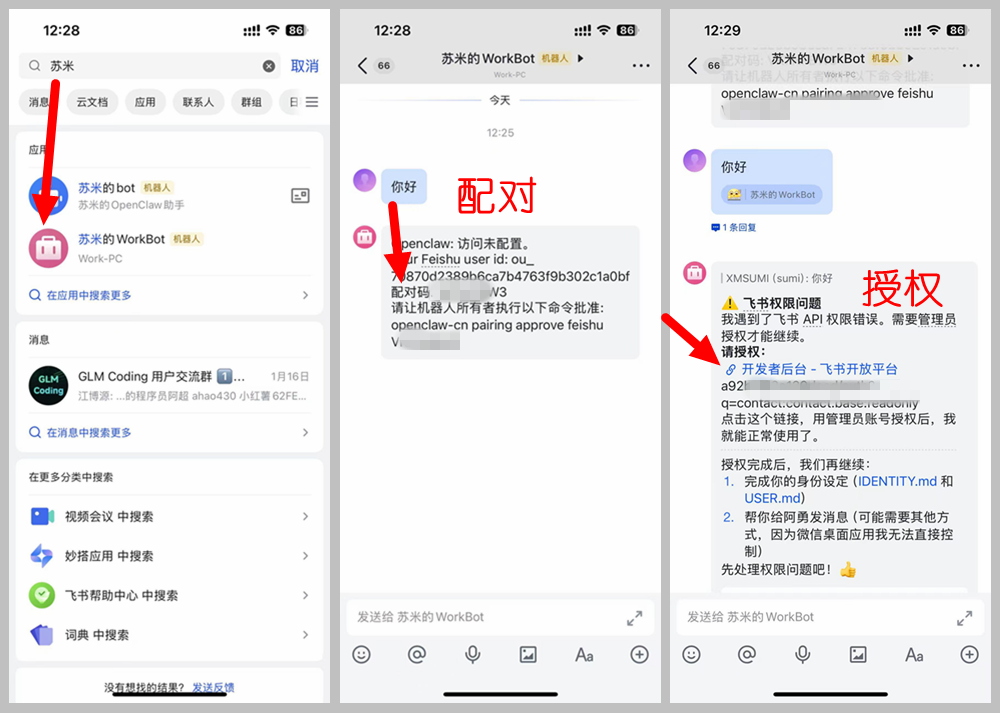

在飞书客户端中,将刚才创建的机器人搜索并直接发起私聊

发送测试消息,例如:“你好”或“介绍一下你自己”。

首次使用还需要完成配对和授权,机器人会回复一个 配对码。您需要在CMD下运行此代码:

openclaw-cn pairing approve feishu <配对码>

运行后再终端执行:

openclaw-cn gateway

即可正常对话。

模型配置

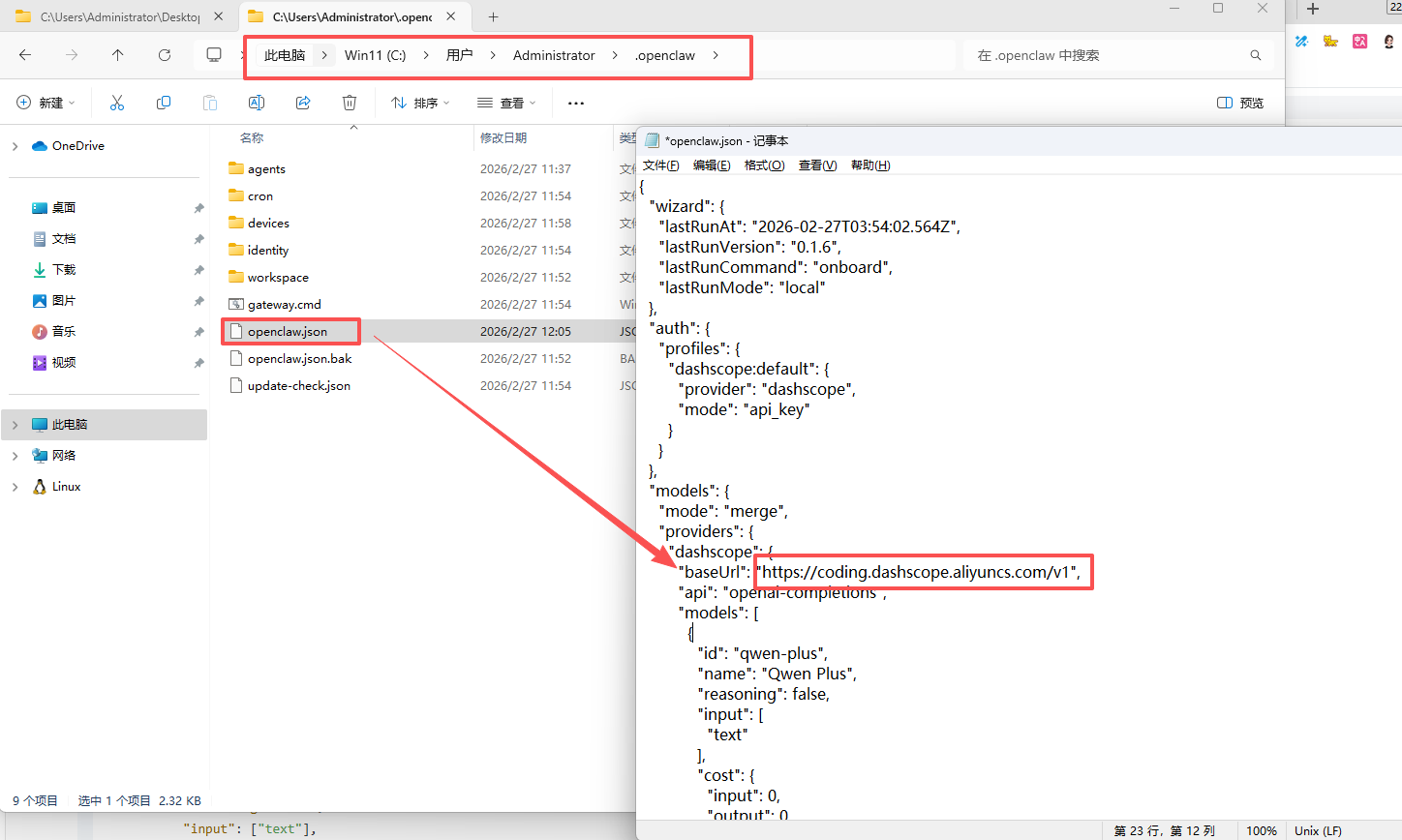

因为前面跳过了模型的配置,所需要正常调用阿里云百炼Coding模型还需要单独进行文件配置

配置文件在C:\Users\用户名改成你电脑的\.openclaw\openclaw.json

直接把models和agents一整块修改成:

"models": {

"mode": "merge",

"providers": {

"bailian": {

"baseUrl": "https://coding.dashscope.aliyuncs.com/v1",

"apiKey": "sk-sp-改成你的API key",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "qwen3-max-2026-01-23",

"name": "qwen3-max-2026-01-23",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-next",

"name": "qwen3-coder-next",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-plus",

"name": "qwen3-coder-plus",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "MiniMax-M2.5",

"name": "MiniMax-M2.5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "glm-5",

"name": "glm-5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "glm-4.7",

"name": "glm-4.7",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "kimi-k2.5",

"name": "kimi-k2.5",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 32768

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "bailian/qwen3.5-plus"

},

"models": {

"bailian/qwen3.5-plus": {},

"bailian/qwen3-max-2026-01-23": {},

"bailian/qwen3-coder-next": {},

"bailian/qwen3-coder-plus": {},

"bailian/MiniMax-M2.5": {},

"bailian/glm-5": {},

"bailian/glm-4.7": {},

"bailian/kimi-k2.5": {}

},

"workspace": "C:\\Users\\Administrator\\.openclaw\\workspace",

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},

这个时候就可以在Agent(代理)里面修改和使用模型了

总结

通过本次在 Windows 本地的部署实践,可以轻松入门OpenClaw中文版,并上手使用。

低门槛部署:通过 PowerShell 脚本屏蔽了 Node.js 环境配置的复杂性,使得非专业运维人员也能在几分钟内完成环境搭建。

灵活的模型适配:对阿里云百炼的原生支持,使得国内用户能够低成本地使用高质量的中文大模型能力,无需处理复杂的代理或网络问题。

稳定的通信机制:采用飞书长连接模式,有效解决了传统 HTTP 回调在本地部署场景下因公网 IP 缺失或网络波动导致的消息丢失问题。

适用性建议: 该方案非常适合个人新手小白入手的本地电脑部署

阿里云百炼专属优惠券链接:

https://www.aliyun.com/activity/ecs/clawdbot