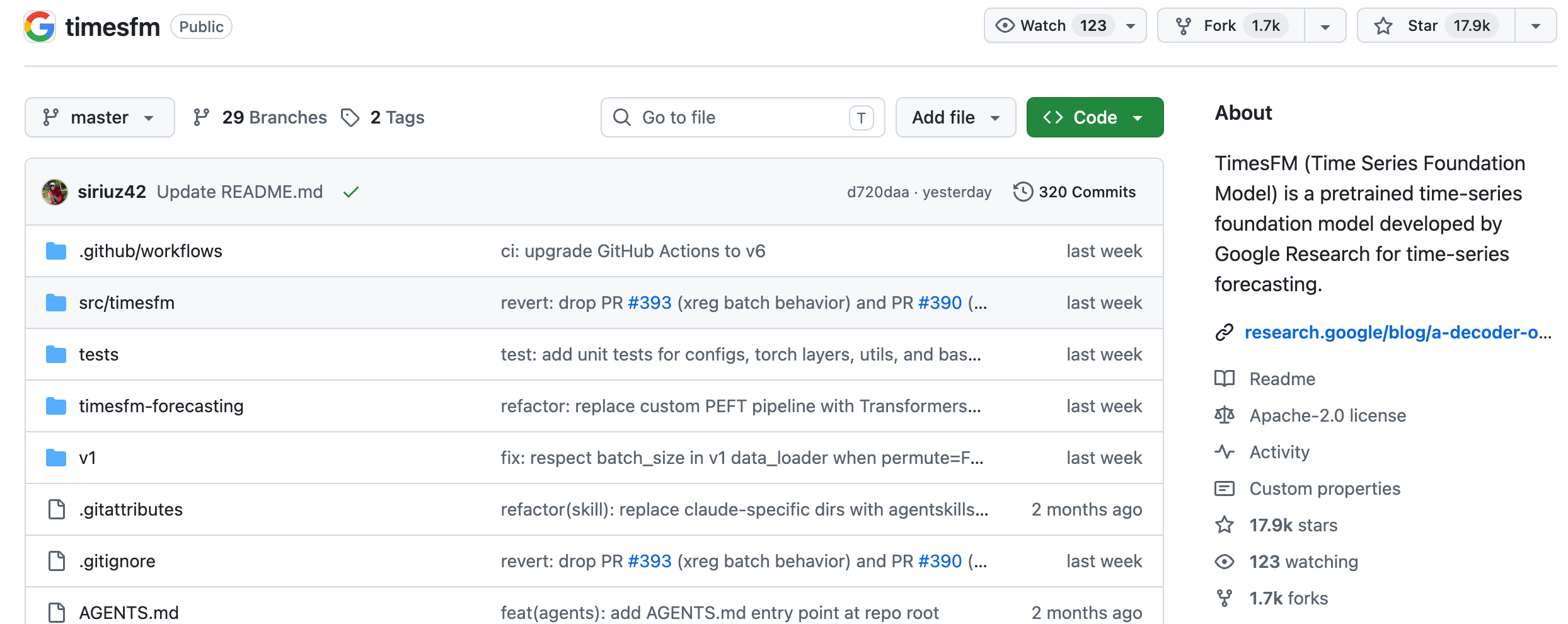

苏米注:Google Research 团队开源的 TimesFM 在 GitHub 上已经斩获 17.9K Star,在全球趋势榜冲到前三。在时间序列预测这个小众但极其实用的领域,能引起这么大轰动的项目真不多见。今天我来详细拆解这个"黑科技"的核心亮点和使用方法。

一、为什么 TimesFM 是黑科技

传统的时间序列预测,哪怕是资深数据分析师,也得经历一套折磨人的流程:收集数据、清洗数据、调参、训练、验证……光是跑通一个新数据集就能让人头大半天。

TimesFM 直接把这套流程砍掉了——扔进去数据,开箱出预测结果,零训练,就这么简单。

苏米注:更夸张的是,这个模型是在 1000 亿个真实世界时间点上预训练而成的,涵盖了各种场景的数据。不管你是预测电商销量、网站流量,还是股票价格、环境监测数据,它都能直接上手,不需要针对你的特定场景微调,效果还能打平甚至超过很多专门训练的传统模型。

二、项目简介

TimesFM 是 Google Research 团队开发的一款预训练时间序列基础模型,专门用于时间序列预测任务。

这个项目最厉害的地方,就是把 NLP 领域的大模型思路移植到了时间序列预测上。它采用了仅解码器(decoder-only)的 Transformer 架构,就像 GPT 系列模型一样,通过海量数据预训练学会了时间序列的通用模式,然后就能在各种任务上零样本应用。

TimesFM 2.5 版本升级亮点:

- 参数从 500M 降到了 200M,更小更轻

- 支持的上下文长度从 2048 提升到了 16k,能看更长的历史数据

- 增加了可选的 30M 分位数头,支持连续分位数预测,最多能预测 1000 个步长

- 去掉了频率指示器,使用起来更简单

三、核心亮点

1. 1000 亿时间点的预训练,知识量爆棚

TimesFM 的底气,来自于它海量的预训练数据。Google 在发布前,已经用 1000 亿个真实世界的时间点对模型进行了预训练,这些数据涵盖了:

- 谷歌趋势

- 维基百科页面浏览量

- 各类公开数据集

- 合成数据

时间粒度包括小时、天、周、月等等。趋势、季节性、突变、周期性……这些时间序列里的通用规律,它早就摸得门儿清了。

2. 零样本预测,开箱即用

这是 TimesFM 最受追捧的卖点,也是最能戳中从业者爽点的地方。

传统的时间序列预测模型,每换一个场景都得重新微调,甚至重新训练,流程繁琐不说,还得有一定的专业知识才能搞定。

苏米注:TimesFM 实现了真正的零样本预测。就是你不需要针对自己的数据集做任何训练或微调,直接把数据扔进去,它就能给你预测结果。

3. 不只是点估计,还能给置信区间

很多传统模型只能给你一个点估计,告诉你"明天销量大概是 1000",但你心里肯定没底——是 900 到 1100 之间,还是 500 到 1500 之间?这个波动范围太重要了。

TimesFM 2.5 版本增加了一个可选的 30M 分位数头,支持连续分位数预测。也就是说,它不只告诉你"明天销量大概是 1000",还能告诉你"有 90% 的概率在 900 到 1100 之间",甚至能给出 10% 到 90% 的各个分位数。

踩坑记录:这对于做决策太重要了,你能清楚地知道预测的不确定性有多大。

4. 已经集成到 Google 全家桶

TimesFM 不只是一个开源项目,它已经被集成到了 Google 的多个产品中:

- BigQuery ML:企业级 SQL 查询,可扩展性和可靠性都没得说

- Google Sheets:日常电子表格就能用,普通人也能轻松上手

- Vertex Model Garden:Docker 化端点,支持 Agent 调用

这意味着不管你是数据科学家、业务分析师,还是普通用户,都能找到适合自己的使用方式。

四、快速入手

安装步骤

首先,克隆仓库:

git clone https://github.com/google-research/timesfm.git

cd timesfm然后创建虚拟环境并安装依赖。Google 推荐使用 uv:

# 创建虚拟环境

uv venv

# 激活环境

source .venv/bin/activate

# 安装 PyTorch 版本

uv pip install -e .[torch]

# 或者安装 Flax 版本

uv pip install -e .[flax]

# 如果需要 XReg(协变量支持)

uv pip install -e .[xreg]苏米注:你还需要根据你的操作系统和加速器(CPU、GPU、TPU 或 Apple Silicon)安装对应的 PyTorch 或 JAX 后端。

使用示例

安装好之后,用起来就更简单了。下面是一个完整的示例:

import torch

import numpy as np

import timesfm

torch.set_float32_matmul_precision("high")

# 加载模型

model = timesfm.TimesFM_2p5_200M_torch.from_pretrained("google/timesfm-2.5-200m-pytorch")

# 配置预测参数

model.compile(

timesfm.ForecastConfig(

max_context=1024,

max_horizon=256,

normalize_inputs=True,

use_continuous_quantile_head=True,

force_flip_invariance=True,

infer_is_positive=True,

fix_quantile_crossing=True,

)

)

# 准备输入数据

point_forecast, quantile_forecast = model.forecast(

horizon=12,

inputs=[

np.linspace(0, 1, 100), # 线性增长的数据

np.sin(np.linspace(0, 20, 67)), # 正弦波数据

],

)

# 查看输出

print(point_forecast.shape) # (2, 12) - 两个序列,每个预测 12 个步长

print(quantile_forecast.shape) # (2, 12, 10) - 均值,然后 10% 到 90% 分位数

五、实际应用场景

TimesFM 的应用场景太广了,几乎所有需要预测未来的地方都能用:

🛒 电商领域

- 销量预测:预测某个商品未来几天、几周的销量,指导库存管理

- 流量预测:预测网站或 APP 的访问量,指导服务器扩容

- 库存优化:根据预测结果优化库存水平,减少积压和缺货

📈 金融领域

- 股票价格预测:虽然不能保证赚钱,但可以作为参考

- 交易量预测:预测交易所的交易量,指导交易策略

- 风险评估:结合置信区间,更好地评估风险

🌍 环境领域

- 气象预测:预测温度、降水等气象指标

- 空气质量预测:预测 PM2.5 等污染物浓度

- 能源消耗预测:预测电力、水等能源的消耗

📱 互联网领域

- 用户增长预测:预测 APP 的用户增长趋势

- 广告效果预测:预测广告的点击率、转化率

- 服务器负载预测:预测服务器的负载,指导资源调度

六、总结

TimesFM 的出现,把时间序列预测的门槛降到了前所未有的低。不管你是数据科学家、业务分析师,还是只是对预测感兴趣的普通人,都能轻松上手。

核心优势:

- ✅ 1000 亿时间点预训练,知识量爆棚

- ✅ 零样本预测,开箱即用,不需要训练

- ✅ 200M 参数,又小又快

- ✅ 支持 16k 上下文,能看更长的历史

- ✅ 不只给点估计,还能给置信区间

- ✅ 完全开源,Apache 2.0 协议,可商用

- ✅ 支持本地运行,数据安全

- ✅ 现成的 LoRA 微调示例,轻松定制

- ✅ 已经集成到 Google 全家桶,场景覆盖全