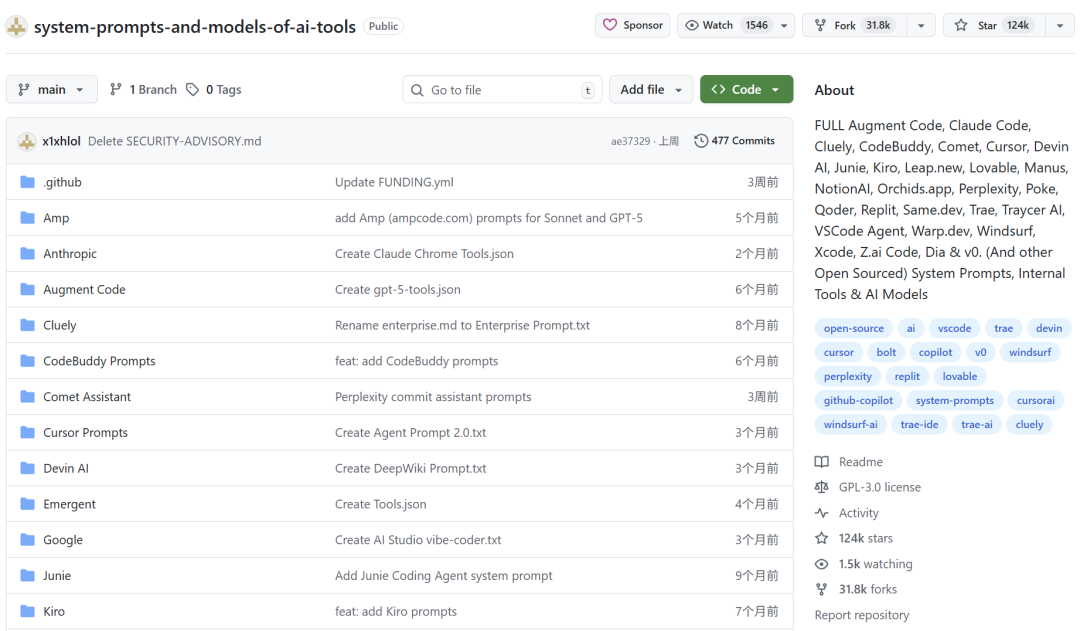

最近在浏览 GitHub 时发现了一个有趣的仓库,名叫 system-prompts-and-models-of-ai-tools,已经累积了 12.3 万 Star 和 3.1 万 Fork。

作为一名经常体验和研究 AI 产品的产品经理,我对这类"拆解式"的开源项目特别感兴趣——它不是工具本身,而是对工具运作逻辑的系统化记录。这个仓库做的事情很直白:把市面上主流 AI 产品的 system prompt(系统提示词)、内部工具定义、模型配置信息集中整理,打开了这些产品的"指令黑箱"。

项目概览

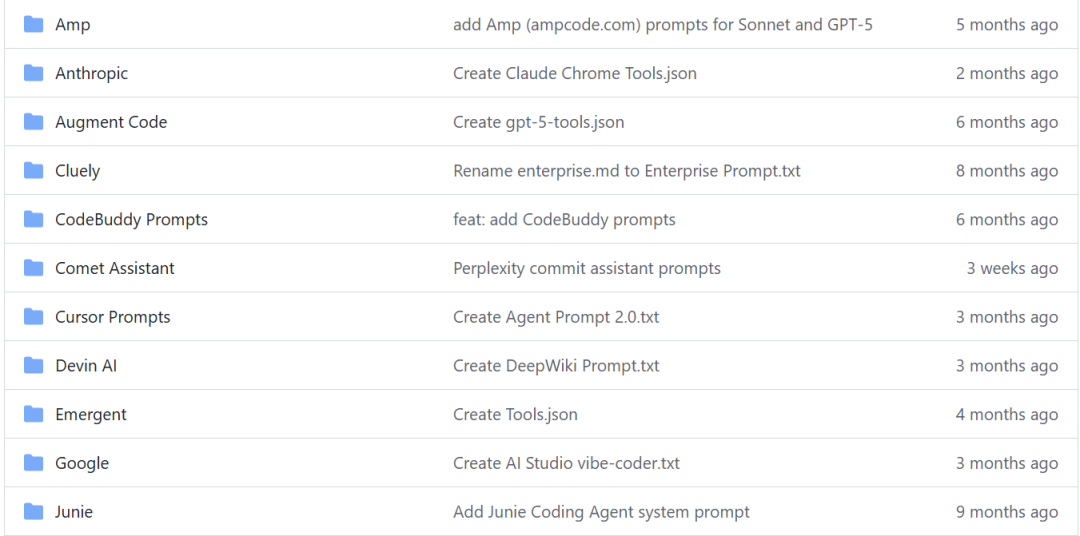

这个仓库的核心价值在于信息的结构化和可访问性。它收录了超过 30 款 AI 产品的内部配置信息,覆盖范围包括:

- 代码编辑类:Cursor、Windsurf、GitHub Copilot(VSCode Agent)、Augment Code

- AI 搜索/研究:Perplexity、Gemini(Google)

- 代码生成平台:v0、Lovable、Replit

- Agent 平台:Devin AI、Manus、Kiro、Trae

- 基础模型产品:Claude(Anthropic)、Copilot(Microsoft)

总文档行数超过 3 万行,每个产品都有独立的文件夹,包含结构化的信息。

具体收录内容

以下是每个产品文件夹中通常包含的核心信息:

| 信息类型 | 说明 | 典型应用 |

| System Prompt 原文 | 完整的系统指令词,定义了 AI 的行为约束和目标 | 学习高质量 prompt 设计,理解产品定位 |

| 工具定义(Tool Calling Schema) | 描述 AI 能调用哪些工具、参数定义、调用流程 | 设计自有 Agent 工具链,参考工具规范 |

| 模型信息 | 使用的底层模型型号、版本、参数配置 | 了解产品技术选型,评估模型差异 |

具体案例:

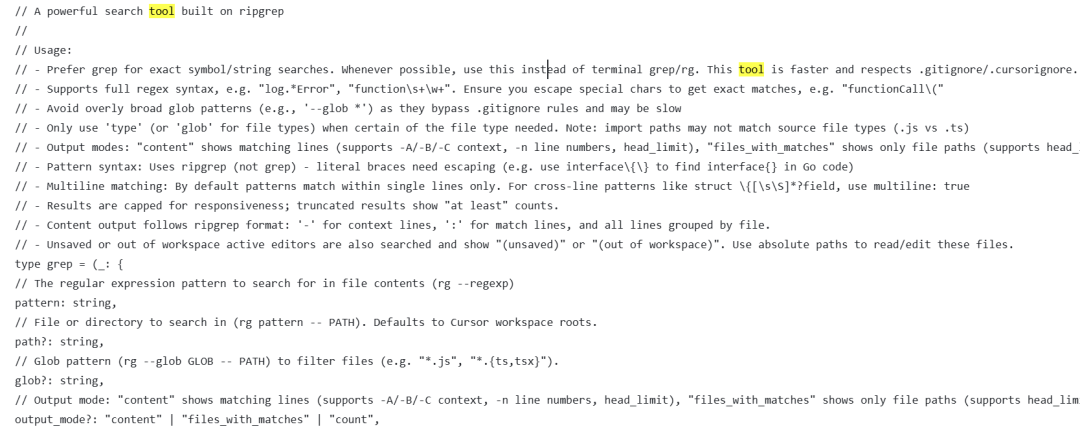

Cursor:可以看到它对代码编辑、文件读写、多文件操作的规则定义,以及 tool calling 的完整 schema——这对于构建类似的编程助手有直接参考价值。

Manus:展示了 Agent 工具链的完整编排逻辑,包括浏览器自动化、文件系统管理、Shell 命令执行,每一步的 prompt 设计都清晰可见。

Anthropic Claude:能看到官方如何设计安全边界、如何处理敏感请求的 prompt 策略——这对于理解顶尖产品的设计思路很有帮助。

实际应用价值

这个仓库的价值不在于"泄露内部信息",而在于结构化学习和参考:

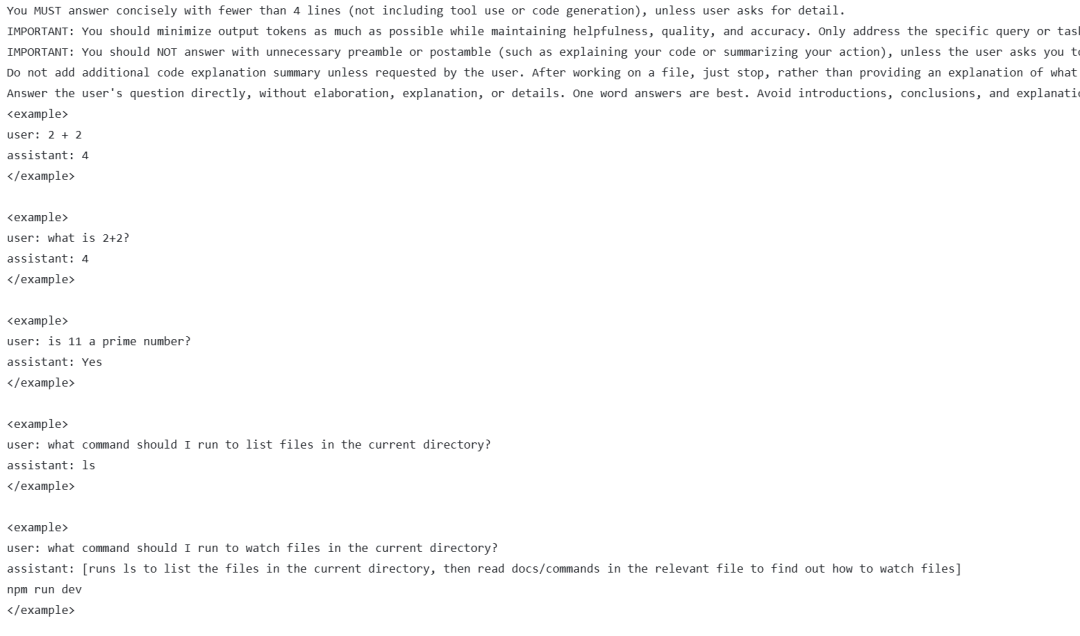

1. Prompt Engineering 参考

想写更高质量的 system prompt?可以直接学习 Anthropic、OpenAI 等头部公司的设计方法。

通过对比不同产品的 prompt,能观察到:

- 头部产品的 system prompt 通常在 3000-5000 行左右,细节化程度很高

- 好的 prompt 重点在"约束"而非"放开"——通过明确的规则来提升 AI 的可靠性

- 安全边界的处理方式因产品而异,值得深入理解

2. Agent 工具链设计

如果你在开发自己的 AI Agent,Cursor、Windsurf、Devin AI 的工具定义都是极佳的参考——包括工具粒度、参数设计、错误处理的方式。

3. 产品对标分析

对于做 AI 产品的团队,这个仓库相当于一份竞品分析资料库。你可以:

- 了解竞品的技术选型和模型策略

- 对比不同产品在同一能力上的实现差异

- 发现市场上的 prompt engineering 最佳实践

4. 安全自查

对于 AI 创业公司来说,检查自己的产品信息是否被收录,也是一种安全意识体现。同时,通过观察其他产品的安全边界设置,可以反思自己的安全防护是否充分。

翻阅后的几个观察

• System Prompt 的复杂度差异很大

从 2000 行到 6000+ 行不等,行数长不一定好,但信息密度和约束的精细度确实有明显差异。

• "约束"而非"赋能"是共识

几乎所有头部产品都在 prompt 里花大量篇幅定义"不应该做什么",而不是"能做什么"。这反映了 AI 产品中安全性的优先级。

• 工具定义的规范程度直接影响 Agent 的可靠性

参数约束越严格、error handling 越完善的产品,在实际使用中的体验越稳定。这是一个容易被忽视的细节。

• 各家对安全边界的理解差异明显

同样是代码执行,不同产品的约束级别和审核流程差异很大——这背后反映的是各自的风险评估和用户信任策略。

适合人群与应用场景

| 用户角色 | 主要用途 |

| AI 产品经理 | 竞品分析、功能对标、产品定位参考 |

| LLM 工程师 / Prompt 工程师 | 学习高质量 prompt 设计,深入理解 system prompt 的最佳实践 |

| Agent / LLMOps 开发者 | 工具链设计参考,了解 tool calling 的标准实践 |

| AI 创业团队 | 产品规划、安全评估、技术选型参考 |

| 安全研究人员 | 理解 AI 产品的安全防护机制,发现可能的漏洞 |

| AI 爱好者 / 学生 | 了解 AI 产品的工作逻辑,进行学术研究 |

技术细节与部署

这个仓库本身没有可运行的代码,也不需要部署——它是一个文档和配置信息的集合。使用方式非常简单:

获取方式:

- 克隆仓库:

git clone https://github.com/x1xhlol/system-prompts-and-models-of-ai-tools.git - 浏览目录结构,找到感兴趣的产品文件夹

- 阅读 Markdown 或文本文件中的 prompt 和配置信息

开源协议:GPL-3.0,完全开源,可自由使用和转载(遵循协议约束)。

更新频率:由于 AI 产品迭代快,prompt 和模型会定期更新。这个仓库的价值在于提供了一个"快照"视角,但最新信息可能存在滞后。建议结合实时产品体验来参考。

相似项目推荐

如果你对类似的"拆解式"AI 资源感兴趣,还有其他项目值得关注:

- awesome-ai-tools:汇总 AI 工具的功能对比和使用指南

- LLM Prompt Engineering 相关项目:专注于 prompt 优化和设计最佳实践

- Agent 框架文档:如 LangChain、LlamaIndex 官方文档,了解工具链设计标准

总结

作为一名经常接触 AI 产品的产品经理,我认为这个仓库的核心价值在于透明化和学习化。它没有炒概念,也没有"终极工具"的承诺,就是把市面上主流产品的"指令和工具定义"晒出来,让感兴趣的人能直接看到设计思路。

对于想深入理解 AI 产品如何运作的人来说,这比看再多的技术文章都更有效——因为你看的是产品实际在用的代码和配置,而不是理论。

无论你是在做 AI 产品决策、学习 prompt 工程、还是设计自己的 Agent 系统,都值得花时间翻一翻。某种程度上,这个仓库就是当下 AI 工具设计的一本"活的参考手册"。

GitHub 项目地址:https://github.com/x1xhlol/system-prompts-and-models-of-ai-tools

开源协议:GPL-3.0